Czy domeny cieni są dobre? Ryzyka, wykrywanie i przewodnik po zapobieganiu

Dowiedz się, dlaczego domeny cieni to szkodliwe techniki black-hat SEO. Poznaj ryzyka, w tym kary wyszukiwarek, przekierowanie ruchu, dezorientację marki oraz j...

Dowiedz się, dlaczego strony-cienie szkodzą SEO, jak marnują budżet indeksowania, powodują problemy z duplikacją treści oraz poznaj sprawdzone strategie ich eliminacji z Twojej strony internetowej.

Tak, strony-cienie są zazwyczaj szkodliwe dla SEO. Marnują budżet indeksowania, powodują problemy z duplikacją treści, rozpraszają moc linków i negatywnie wpływają na doświadczenie użytkownika. Wyszukiwarki mogą karać strony z nadmiarem stron-cieni, co prowadzi do niższych pozycji i ograniczonej widoczności organicznej.

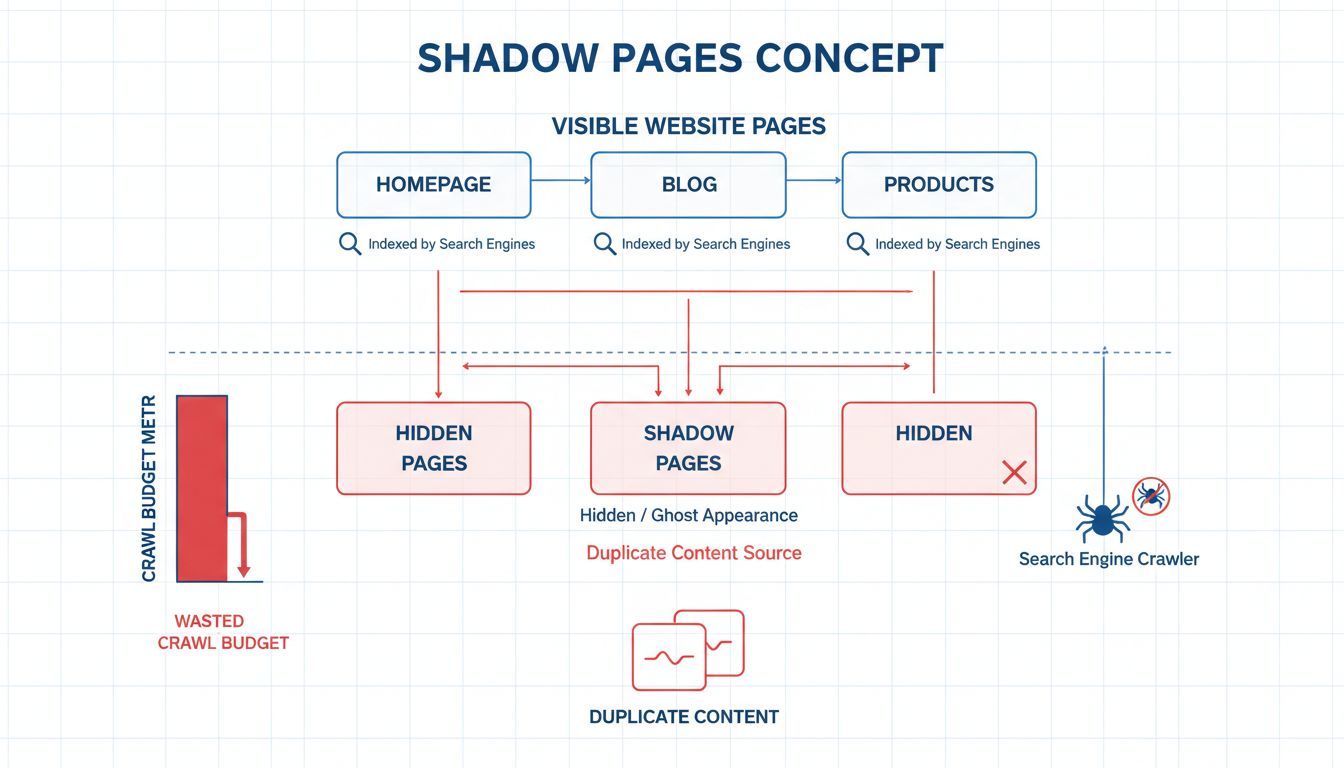

Strony-cienie, znane również jako strony-duchy, to podstrony istniejące w obrębie Twojej witryny, które pozostają ukryte przed użytkownikami i często nie są indeksowane przez wyszukiwarki. Zazwyczaj powstają one nieumyślnie, na skutek nieprawidłowej architektury strony, dynamicznego generowania treści bez odpowiedniego linkowania lub niewłaściwego zarządzania przekierowaniami. W przeciwieństwie do celowo ukrywanych podstron, które pełnią określone funkcje, strony-cienie są problemem strukturalnym, z którym wyszukiwarki mają trudność w prawidłowej kategoryzacji i indeksowaniu. Podstawowy problem polega na tym, że takie strony zużywają cenne zasoby bez realnego wkładu w SEO Twojej witryny czy doświadczenie użytkownika.

Obecność stron-cieni prowadzi do lawinowo narastających problemów. Gdy roboty wyszukiwarek napotykają takie strony, muszą zdecydować, czy je indeksować, co odciąga uwagę od ważniejszych treści. To marnotrawstwo staje się szczególnie odczuwalne wraz z rozwojem strony, ponieważ każda domena ma ograniczony budżet indeksowania. Każda sekunda poświęcona na strony-cienie to sekunda zabrana stronom istotnym z punktu widzenia biznesu i zaangażowania użytkowników.

Wyszukiwarki, takie jak Google, przydzielają każdej witrynie określony budżet indeksowania, zależny od jej autorytetu, wielkości i częstotliwości aktualizacji. Ten budżet oznacza maksymalną liczbę stron, jaką Googlebot jest w stanie przeskanować w danym przedziale czasowym. Gdy strony-cienie konsumują część tego limitu, mniej istotne strony są indeksowane na czas. Dla dużych witryn, liczących tysiące podstron, to poważny problem bezpośrednio wpływający na tempo odkrywania i pozycjonowania nowych treści.

Problem nasila się, gdy strony-cienie są dynamicznie generowane przez identyfikatory sesji, parametry śledzące czy inne warianty URL. Każda taka kombinacja wygląda dla wyszukiwarki jak osobna strona, co wielokrotnie zwiększa zmarnowany budżet. Jeden produkt z wieloma wariantami parametrów może wygenerować dziesiątki stron-cieni, zjadając budżet, który mógłby być poświęcony kluczowym treściom. W efekcie Twoje posty, strony produktów czy opisy usług mogą być indeksowane tygodniami lub miesiącami zamiast kilku dni.

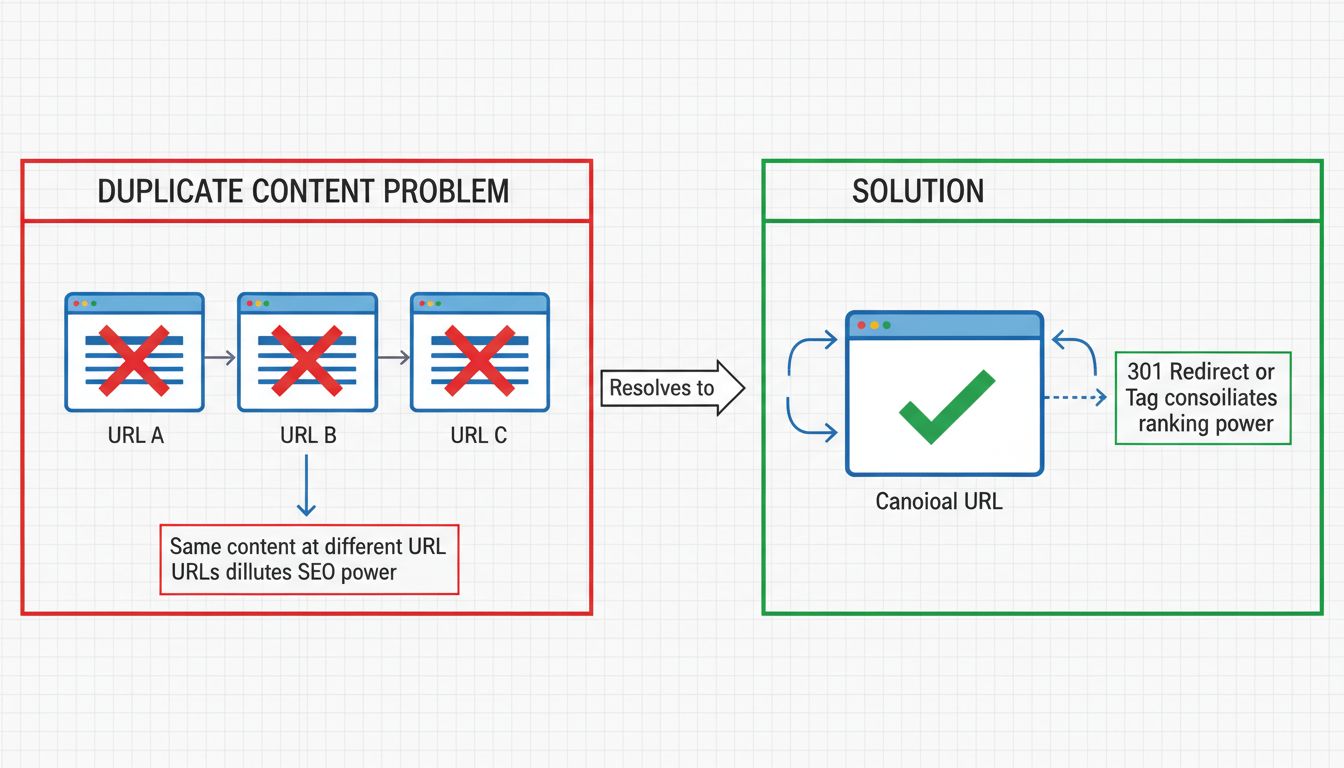

Strony-cienie często zawierają identyczną lub bardzo podobną treść do już zaindeksowanych stron. W efekcie wyszukiwarka napotyka wiele wersji tej samej zawartości i musi zdecydować, która ma być wyświetlana na dane słowo kluczowe. Powoduje to kanibalizację słów kluczowych, gdy własne strony konkurują ze sobą o pozycje. Zamiast konsolidować moc rankingową na jednej stronie, rozpraszasz ją na wiele adresów, co osłabia ogólną skuteczność SEO.

Problem duplikacji to nie tylko zamieszanie rankingowe. Algorytmy Google zostały stworzone do identyfikowania i karania stron, które celowo powielają treści w celu manipulacji wynikami. Choć strony-cienie powstają zwykle nieświadomie, algorytmy nie zawsze potrafią odróżnić przypadkowe duplikaty od celowego spamu. To oznacza ryzyko nałożenia kar ręcznych lub algorytmicznych, co może znacząco ograniczyć widoczność witryny we wszystkich wynikach wyszukiwania, nie tylko dla zduplikowanych stron.

Linki zwrotne są jednym z najważniejszych czynników rankingowych w Google i stanowią swoiste głosy zaufania innych witryn. Gdy strony-cienie zdobywają linki — zarówno wewnętrzne, jak i zewnętrzne — moc linków jest rozpraszana między wieloma podstronami zamiast koncentrować się na głównej treści. Osłabia to autorytet kluczowych stron i ogranicza ich szanse na wysokie pozycje w konkurencyjnych frazach.

Szczególnie problematyczne jest linkowanie wewnętrzne. Jeśli architektura generuje wiele adresów dla tej samej treści, a niektóre z nich otrzymują linki wewnętrzne, a inne nie, to moc linków się rozprasza. Strona, która powinna otrzymać dziesięć linków wewnętrznych, dostaje pięć, a wariant-cień — pozostałe pięć. Taka fragmentacja uniemożliwia zgromadzenie wystarczającego autorytetu przez jedną stronę, by skutecznie rywalizować o wartościowe słowa kluczowe.

Zrozumienie, jak powstają strony-cienie, jest kluczowe, by im zapobiegać. Najczęstszym winowajcą są dynamiczne parametry URL, np. identyfikatory sesji, kody śledzące czy preferencje użytkownika, które generują unikalne adresy dla tej samej treści. Sklepy internetowe szczególnie często zmagają się z tym problemem, gdy filtry produktów, sortowanie czy widoki tworzą nowe adresy. Systemy CMS czasem generują strony-cienie przez parametry paginacji, wersje do druku czy mobilne adresy, które nie są odpowiednio konsolidowane przez tagi kanoniczne.

Nieprawidłowe wdrożenie przekierowań także generuje strony-cienie. Gdy witryny migrują treści, zmieniają strukturę adresów lub łączą podstrony, stare adresy powinny być przekierowane do nowych za pomocą przekierowań 301. Jeśli przekierowania nie są poprawnie skonfigurowane, wyszukiwarka może zaindeksować zarówno stare, jak i nowe adresy, generując problem duplikacji. Podobnie, brak prawidłowego przekierowania między wersjami HTTPS oraz www/non-www prowadzi do powstawania stron-cieni rywalizujących o pozycje.

Tagi kanoniczne wskazują wyszukiwarkom, która wersja strony powinna być traktowana jako główna, gdy wiele adresów zawiera podobną lub identyczną treść. Dodając znacznik rel=“canonical” na stronach-cieniach, konsolidujesz sygnały rankingowe i zapobiegasz marnowaniu budżetu na duplikaty. Tag kanoniczny musi wskazywać na podstawową wersję strony, którą chcesz pozycjonować.

Wdrożenie tagów kanonicznych wymaga przemyślanej strategii. W e-commerce przy filtrowaniu produktów tag kanoniczny powinien prowadzić do głównej strony produktu. W przypadku paginacji każda strona powinna mieć kanoniczny tag wskazujący na siebie, lub można użyć tagów rel=“next” i rel=“prev” do określenia relacji między stronami. Kluczowe jest, aby każda strona-cień jasno wskazywała, która strona ma otrzymać moc rankingową.

Meta tag noindex uniemożliwia wyszukiwarkom indeksowanie wybranych stron, pozostawiając je dostępnymi dla użytkowników. To dobre rozwiązanie dla stron służących celom wewnętrznym, które nie powinny pojawiać się w Google, np. strony z podziękowaniami, logowania czy wewnętrzne wyszukiwarki. Stosując noindex na stronach-cieniach, które nie wnoszą wartości dla użytkownika z wyszukiwarki, oszczędzasz budżet indeksowania i eliminujesz konkurencję dla kluczowych treści.

Wdrożenie noindex wymaga ostrożności, by nie zablokować przypadkowo ważnych podstron. Warto przeprowadzić audyt, by zidentyfikować strony faktycznie niepotrzebne w indeksie. Typowe kandydatki to strony zduplikowane, ubogie treściowo oraz stworzone wyłącznie do nawigacji wewnętrznej czy śledzenia. Po ich identyfikacji należy dodać tag noindex i monitorować Google Search Console, by potwierdzić ich usunięcie z wyników.

Najskuteczniejsze długoterminowe rozwiązanie to przebudowa architektury witryny w celu wyeliminowania warunków sprzyjających powstawaniu stron-cieni. Oznacza to konsolidację zduplikowanych treści w jedną stronę autorytatywną, wdrożenie odpowiednich struktur URL, które nie generują zbędnych wariantów i zapewnienie prawidłowego linkowania wszystkich istotnych stron z nawigacji i treści.

Dla treści dynamicznych warto wdrożyć przepisywanie adresów (URL rewriting), by tworzyć czyste, statycznie wyglądające adresy bez ID sesji czy parametrów śledzących. Stosuj spójne struktury URL w całej witrynie, a wszystkie warianty strony (mobilna, desktopowa, do druku) udostępniaj pod jednym adresem, wykorzystując responsywny design lub negocjację treści zamiast osobnych adresów. Dzięki temu nie tylko eliminujesz strony-cienie, ale także poprawiasz doświadczenie użytkownika i ułatwiasz indeksowanie.

| Narzędzie | Zastosowanie | Kluczowe funkcje |

|---|---|---|

| Google Search Console | Oficjalny monitoring indeksacji | Pokazuje zaindeksowane i wykluczone strony, błędy indeksacji, problemy z pokryciem |

| Screaming Frog | Audyt techniczny SEO | Przeszukuje całą stronę, wykrywa duplikaty treści, łańcuchy przekierowań |

| Ahrefs | Kompleksowa analiza SEO | Analiza linków zwrotnych, szacowanie budżetu indeksowania, wykrywanie duplikatów treści |

| Semrush | Analiza konkurencji | Audyt witryny, techniczne problemy SEO, status indeksacji stron |

| Moz Pro | Zestaw narzędzi SEO | Diagnostyka indeksowania, wykrywanie duplikatów, monitorowanie pozycji |

Regularne audyty strony są niezbędne, by zidentyfikować i wyeliminować strony-cienie zanim zaszkodzą wydajności SEO. Google Search Console dostarcza najbardziej wiarygodnych danych o tym, które strony Google wykrył i zaindeksował. Raport Pokrycie pokazuje wykluczone strony i powody wykluczenia, pomagając odnaleźć strony-cienie utworzone przez parametry URL, paginację czy błędy przekierowań.

Screaming Frog umożliwia dogłębne przeskanowanie całej witryny, symulując sposób widzenia jej przez roboty wyszukiwarek. Narzędzie to wykrywa zduplikowaną treść, łańcuchy przekierowań, brakujące tagi kanoniczne i inne techniczne problemy generujące strony-cienie. Regularne audyty Screaming Frogiem pozwalają wychwycić problemy zanim negatywnie odbiją się na SEO. Funkcja wykrywania podobnych treści pomaga konsolidować duplikaty i usprawnić strukturę witryny.

Stosowanie dobrych praktyk od początku zapobiega problemowi stron-cieni. Zawsze używaj tagów kanonicznych na stronach o podobnej treści, szczególnie w e-commerce z filtrowanymi wynikami i paginacją. Upewnij się, że plik robots.txt nie blokuje przypadkowo ważnych stron, a umożliwia indeksowanie tylko tym, które powinny być widoczne. Skonfiguruj sitemap.xml tak, by zawierał jedynie strony przeznaczone do indeksowania, pomijając strony-cienie i ubogie treściowo.

Ustal jasne wytyczne dotyczące struktury adresów dla zespołu deweloperskiego. Unikaj stosowania ID sesji, parametrów śledzących czy wskaźników preferencji użytkownika w adresach URL. Zamiast tego korzystaj z cookies lub sesji po stronie serwera, które nie generują nowych adresów. Dla treści dynamicznych stosuj przepisywanie adresów (URL rewriting), by tworzyć czyste, spójne adresy łatwe do zrozumienia i indeksowania przez wyszukiwarki.

Wdrażaj poprawne przekierowania 301 przy każdej zmianie struktury lub konsolidacji stron. Monitoruj łańcuchy przekierowań, by nie przekraczały trzech przeskoków — nadmiarowe przekierowania marnują budżet indeksowania i mogą powodować problemy z indeksacją. Regularnie testuj wszystkie przekierowania, by upewnić się, że działają prawidłowo i prowadzą do odpowiednich podstron.

Strony-cienie to poważne wyzwanie SEO, które może podważyć widoczność strony w wyszukiwarce i potencjał ruchu organicznego. Przez marnowanie budżetu indeksowania, generowanie duplikatów treści i rozpraszanie mocy linków, strony-cienie uniemożliwiają skupienie uwagi robotów na najważniejszych treściach. Dobrą wiadomością jest to, że powstawaniu stron-cieni można skutecznie zapobiec dzięki prawidłowej architekturze, wdrożeniu tagów kanonicznych i regularnym audytom technicznym.

Działania eliminujące strony-cienie powinny być priorytetem w Twojej strategii SEO na 2025 rok. Zacznij od audytu strony w Google Search Console i Screaming Frog, by zidentyfikować istniejące strony-cienie. Wprowadź tagi kanoniczne na zduplikowanych treściach, stosuj noindex na stronach nieistotnych i przebuduj architekturę, by zapobiec powstawaniu nowych stron-cieni. Rozwiązując ten problem technicznego SEO, poprawisz efektywność indeksowania, skonsolidujesz moc rankingową i osiągniesz lepszą widoczność oraz ruch organiczny dla swojego biznesu.

Strony-cienie i techniczne problemy SEO mogą znacząco wpłynąć na skuteczność Twojego programu partnerskiego. PostAffiliatePro oferuje kompleksowe narzędzia śledzenia i analityki, które pomogą Ci zidentyfikować i rozwiązać problemy SEO wpływające na widoczność i konwersje. Monitoruj strony partnerskie, analizuj kluczowe metryki i upewnij się, że cała zawartość jest prawidłowo zaindeksowana i zoptymalizowana.

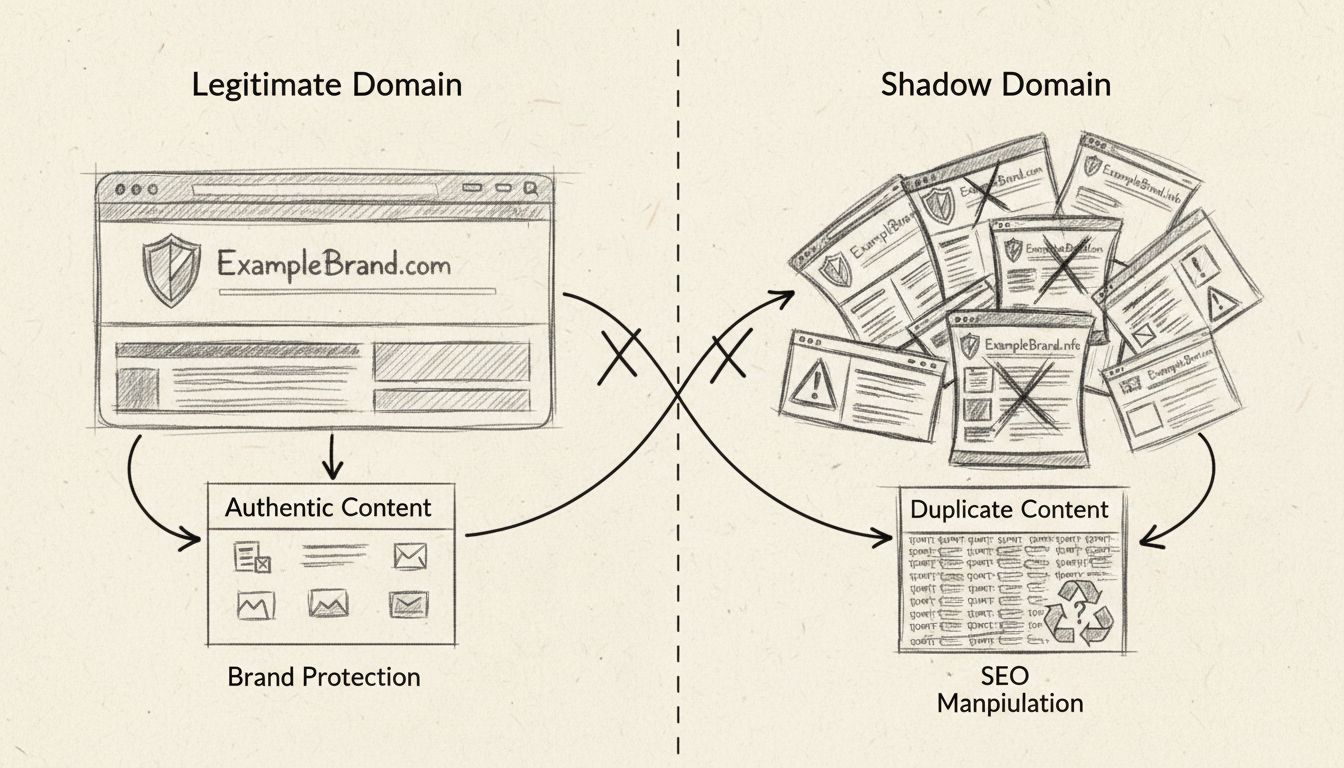

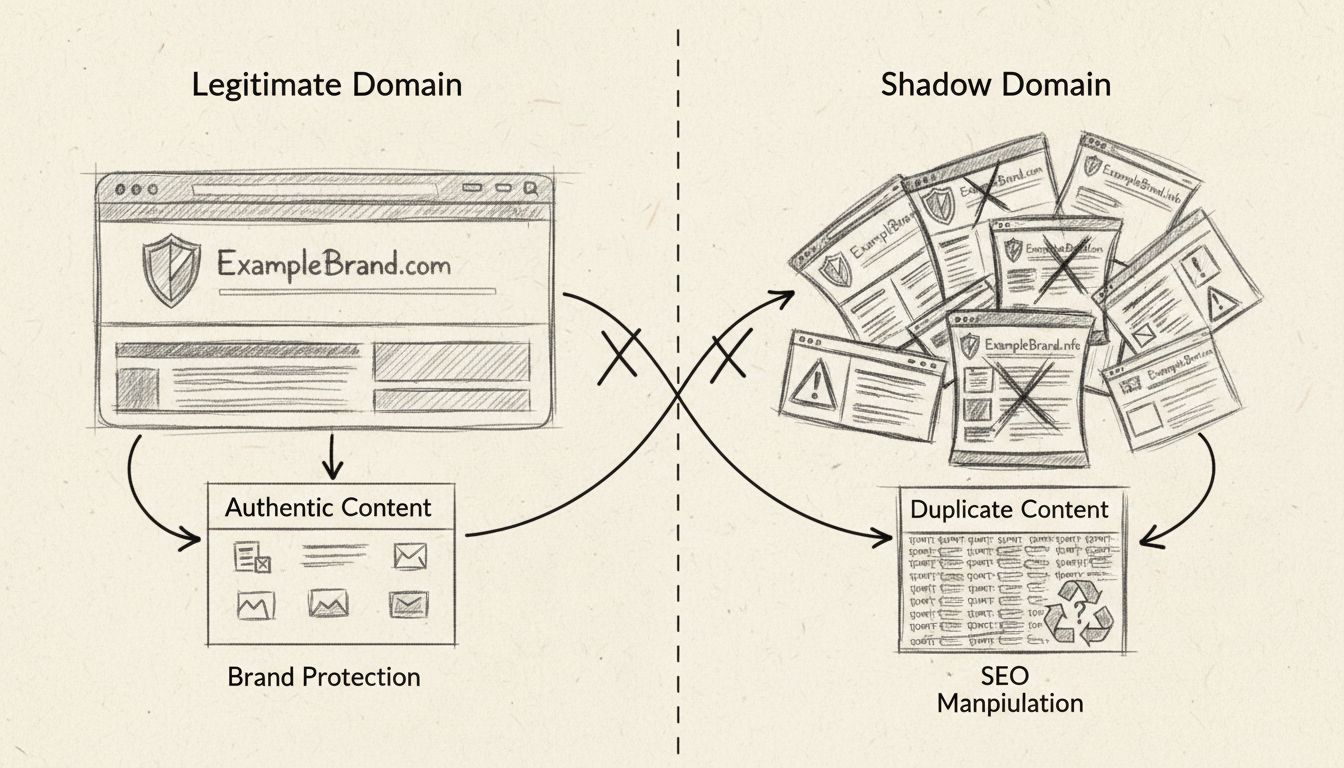

Dowiedz się, dlaczego domeny cieni to szkodliwe techniki black-hat SEO. Poznaj ryzyka, w tym kary wyszukiwarek, przekierowanie ruchu, dezorientację marki oraz j...

Poznaj sprawdzone metody naprawy problemów z duplikacją treści, w tym przekierowania 301, tagi kanoniczne i dyrektywy noindex. Chroń swoje pozycje SEO dzięki ek...

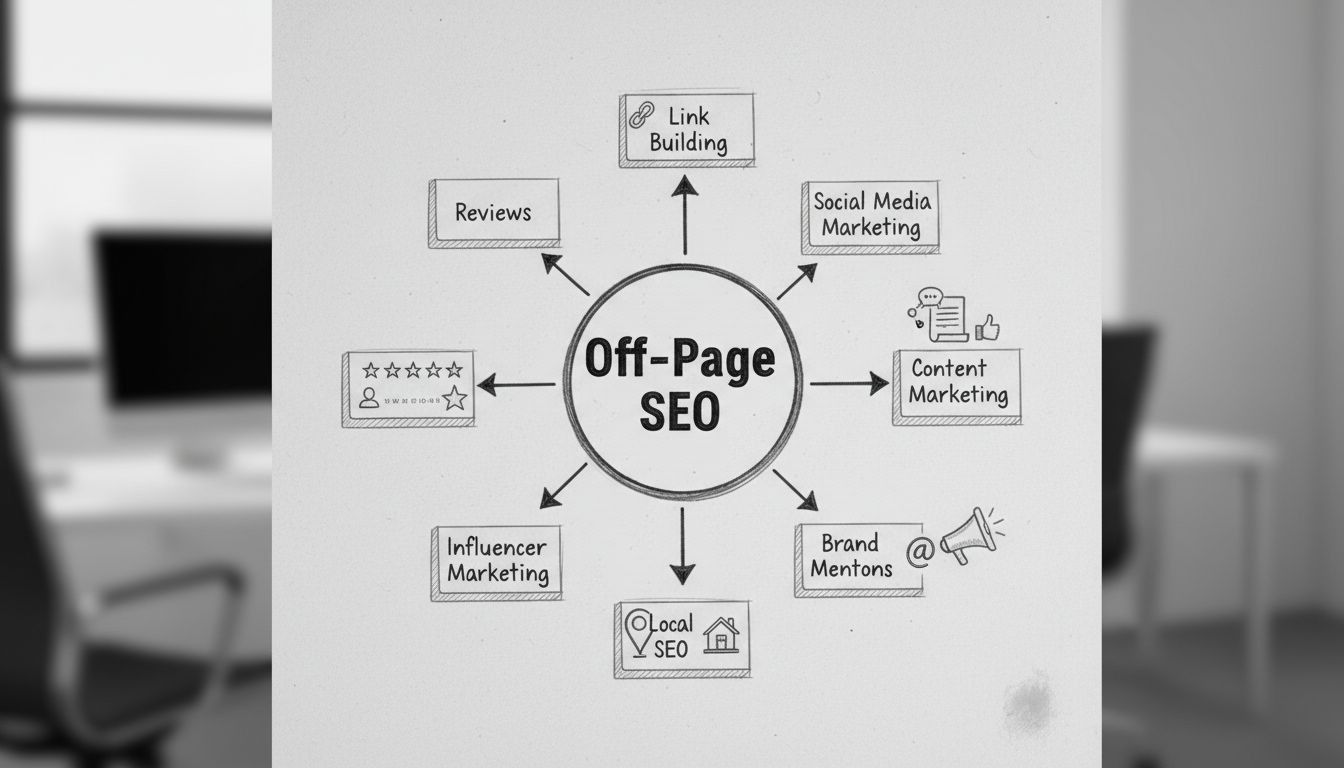

Poznaj najskuteczniejsze techniki SEO poza stroną w 2025 roku. Odkryj budowanie linków, strategie mediów społecznościowych i sprawdzone metody na zwiększenie au...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.