Jak czas ładowania strony wpływa na konwersje afiliacyjne

Dowiedz się, jak czas ładowania strony bezpośrednio wpływa na konwersje afiliacyjne. Poznaj powody, dla których szybko ładujące się strony zmniejszają wskaźnik ...

Dowiedz się, jak sprawdzić czas ładowania swojej strony internetowej za pomocą bezpłatnych i płatnych narzędzi, takich jak Pingdom, Google PageSpeed Insights i GTmetrix. Poznaj kluczowe metryki, benchmarki i strategie optymalizacji na rok 2025.

Możesz sprawdzić czas ładowania swojej strony internetowej za pomocą bezpłatnych narzędzi, takich jak Google PageSpeed Insights, GTmetrix, WebPageTest i Pingdom. Narzędzia te mierzą kluczowe wskaźniki wydajności, w tym Largest Contentful Paint (LCP), Interaction to Next Paint (INP) oraz Cumulative Layout Shift (CLS), pomagając zidentyfikować wąskie gardła wydajności i obszary wymagające poprawy.

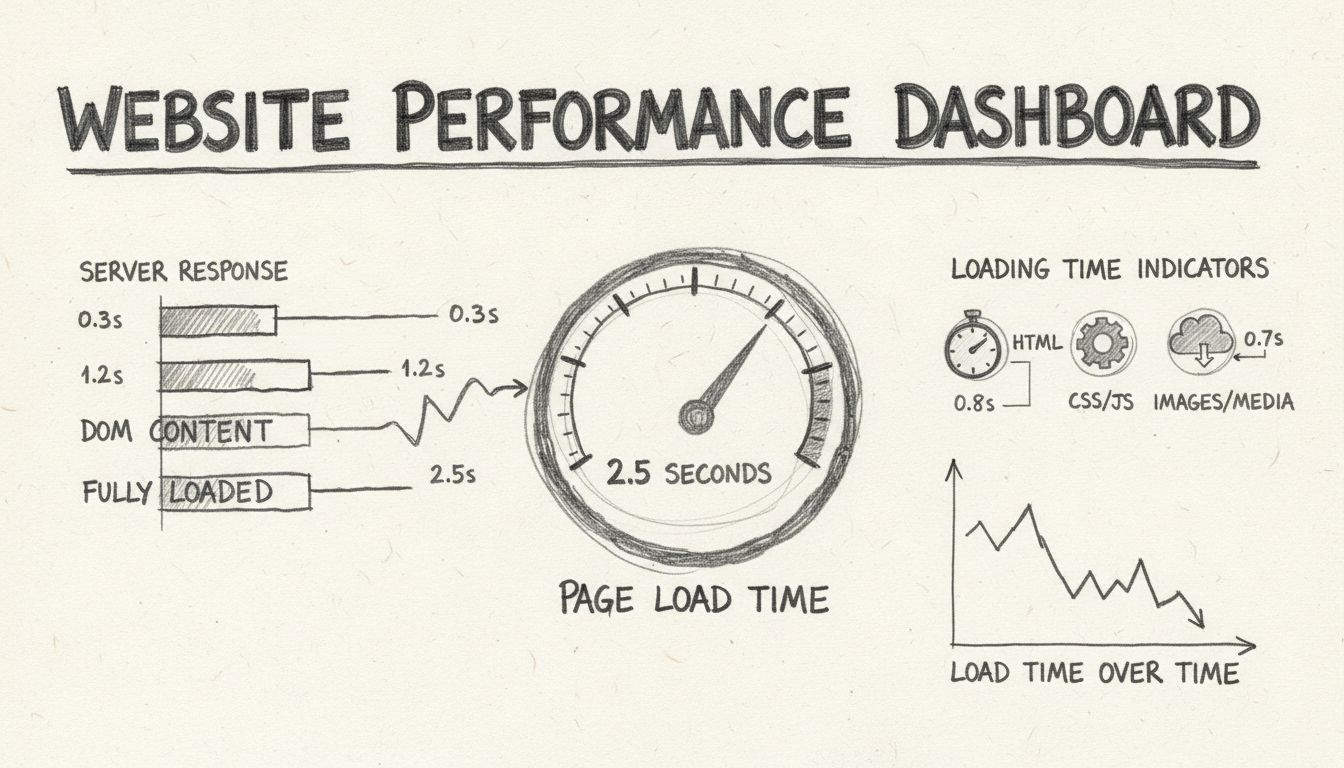

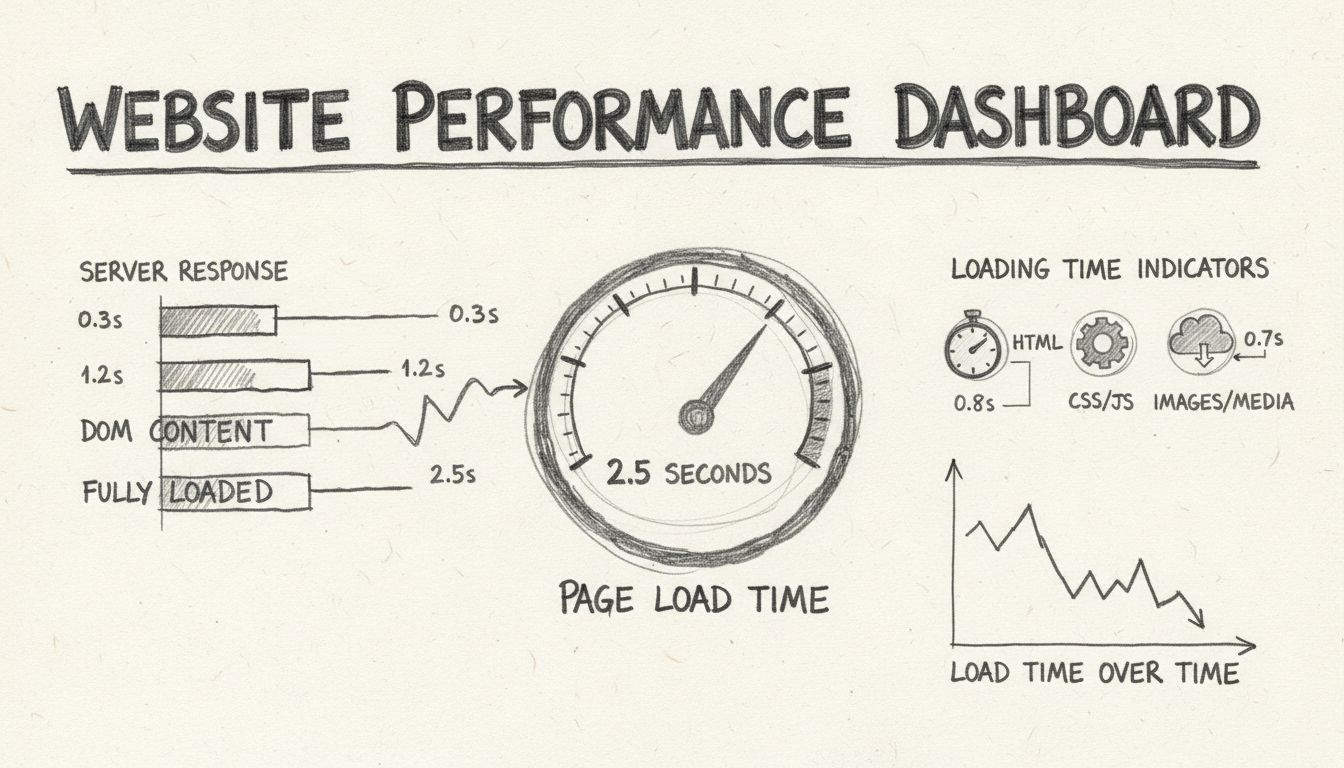

Czas ładowania strony internetowej to jeden z najważniejszych czynników wpływających na doświadczenie użytkownika, pozycjonowanie w wyszukiwarkach oraz wyniki biznesowe. Odwiedzający oczekują, że Twoja strona załaduje się błyskawicznie—badania pokazują, że idealny czas ładowania strony to 0-2 sekundy, a 3 sekundy to maksymalnie akceptowalny próg. Czas powyżej 3 sekund znacząco zwiększa ryzyko opuszczenia strony przez użytkowników. Wiedza o tym, jak mierzyć i monitorować czas ładowania strony, jest kluczowa dla utrzymania konkurencyjności w internecie i zapewnienia odbiorcom pozytywnych doświadczeń podczas korzystania z Twoich treści.

Google PageSpeed Insights to jedno z najpopularniejszych i najbardziej dostępnych narzędzi do sprawdzania czasu ładowania strony. Dostępne na stronie pagespeed.web.dev, to darmowe narzędzie korzysta z Lighthouse i Chrome User Experience Report (CrUX), zapewniając zarówno dane laboratoryjne, jak i rzeczywiste. Narzędzie mierzy Core Web Vitals—kluczowe wskaźniki wydajności Google—i oferuje konkretne zalecenia dotyczące optymalizacji. PageSpeed Insights testuje zarówno wersję mobilną, jak i desktopową strony, integruje się z Google Search Console i dostarcza wskazówek zgodnych z czynnikami rankingowymi Google. Głównym ograniczeniem jest brak rozbudowanej historii testów, co sprawia, że narzędzie lepiej nadaje się do szybkiej oceny niż długofalowego monitorowania wydajności.

GTmetrix łączy metryki Lighthouse i PageSpeed, oferując zrównoważone podejście do testowania wydajności. Plan darmowy pozwala wykonywać testy oraz przeglądać szczegółowe wykresy wodospadowe pokazujące, jak każdy element strony się ładuje. Otrzymujesz ocenę wydajności, zalecenia posortowane według wpływu oraz nagrania wideo z procesu ładowania strony. GTmetrix umożliwia testy z różnych lokalizacji serwerów, co pozwala zobaczyć, jak Twoja strona działa geograficznie. Jednak darmowy plan ogranicza częstotliwość testów i zapewnia jedynie ograniczoną historię, dlatego płatne plany lepiej sprawdzają się przy ciągłym monitoringu.

WebPageTest (webpagetest.org) to potężne, darmowe narzędzie oferujące bardzo szczegółowe wykresy wodospadowe i zaawansowaną analizę wydajności. Jego mocną stroną jest pokazanie, co dokładnie dzieje się podczas ładowania strony, m.in. odtwarzanie wideo całego procesu ładowania, widok „filmstrip” prezentujący postęp wizualny oraz możliwość dostosowania przepustowości sieci w celu symulacji różnych prędkości połączenia. WebPageTest umożliwia testowanie z wielu lokalizacji i zawiera narzędzia porównawcze do benchmarkowania z konkurencją. Minusem jest bardziej techniczny interfejs i większa krzywa uczenia się, dlatego wymaga więcej wiedzy, by poprawnie interpretować wyniki.

Darmowy test szybkości Pingdom (tools.pingdom.com) oferuje przyjazny interfejs idealny dla początkujących. Dostarcza prostą ocenę wydajności, rozbija rozmiar strony według typu treści, pokazuje czas ładowania poszczególnych elementów oraz prezentuje widok wodospadowy ładowania strony. Narzędzie jest świetne do szybkiego sprawdzenia i uzyskania ogólnego podglądu wydajności strony. Jednak darmowa wersja nie zawiera zaawansowanych funkcji, takich jak pomiary Core Web Vitals czy szczegółowa analiza wydajności dostępna w wersji płatnej.

Podczas sprawdzania czasu ładowania strony napotkasz kilka istotnych metryk mierzących różne aspekty wydajności. Zrozumienie tych wskaźników pozwala zidentyfikować konkretne obszary do poprawy i skuteczniej priorytetyzować działania optymalizacyjne.

Largest Contentful Paint (LCP) mierzy czas, w którym największy widoczny element na stronie zostaje wyrenderowany. Może to być duży obraz, blok tekstu lub wideo. Google uznaje LCP na poziomie 2,5 sekundy lub mniej za dobry wynik, powyżej 4 sekund—za zły. LCP jest kluczowy, bo wskazuje, kiedy użytkownicy postrzegają, że główna treść strony się załadowała. Najczęstsze przyczyny słabego LCP to: wolna odpowiedź serwera, blokujący renderowanie JavaScript lub CSS, wolne ładowanie zasobów i opóźnienia po stronie klienta. By poprawić LCP, zoptymalizuj czas odpowiedzi serwera, usuń blokujące zasoby, zastosuj leniwe ładowanie obrazów, użyj nowoczesnych formatów jak WebP i AVIF oraz preloaduj kluczowe zasoby.

Interaction to Next Paint (INP) zastąpił First Input Delay w 2024 roku i mierzy czas między interakcją użytkownika (kliknięcie, dotknięcie, naciśnięcie klawisza) a wizualną reakcją strony. Dobry INP to 200 milisekund lub mniej, powyżej 500 ms to wynik słaby. Metryka ta pokazuje, jak responsywna jest strona na działania użytkownika. Zły wynik INP to najczęściej efekt długiego wykonywania JavaScriptu, ciężkiej manipulacji DOM, nieoptymalnych obsługiwaczy zdarzeń lub blokowania głównego wątku. Popraw INP, dzieląc długie zadania JavaScriptu, używając Web Workers do ciężkich obliczeń, optymalizując obsługiwacze zdarzeń, redukując rozmiar paczki JS i wdrażając code splitting.

Cumulative Layout Shift (CLS) mierzy nieoczekiwane przesunięcia elementów strony podczas ładowania i interakcji. Dobry wynik CLS to 0,1 lub mniej, powyżej 0,25—wynik zły. Metryka ta zapobiega frustrującym sytuacjom, gdy elementy przesuwają się podczas klikania lub czytania. Najczęstsze przyczyny to: obrazy lub wideo bez określonych wymiarów, reklamy i osadzone elementy bez zarezerwowanego miejsca, dynamicznie wstawiana treść, fonty powodujące przeskakiwanie tekstu oraz animacje niewykorzystujące CSS transform. Optymalizuj CLS, ustawiając wymiary dla obrazów i wideo, rezerwując miejsce na reklamy i osadzenia, unikając wstawiania treści powyżej już załadowanej, stosując CSS transform dla animacji i preloadując fonty.

Dla firm wymagających stałego monitorowania wydajności, istnieje kilka zaawansowanych, płatnych narzędzi. Pingdom Premium (od około 10 USD/miesiąc) oferuje monitoring rzeczywistych użytkowników, syntetyczny monitoring z ponad 100 lokalizacji, monitoring transakcji, dostępność, powiadomienia niestandardowe i API. GTmetrix PRO (od około 25 USD/miesiąc) zapewnia nielimitowane testy, częstszy monitoring, więcej lokalizacji serwerów, roczną historię danych, dostęp do API, powiadomienia i nagrania wideo. WebPageTest Premium oferuje priorytetowe testy, więcej lokalizacji, zaawansowane skrypty, dostęp do API i opcje brandingu. Te rozwiązania są idealne dla agencji, e-commerce i firm potrzebujących ciągłego monitorowania oraz szczegółowej historii wydajności.

Zrozumienie, co oznacza dobra wydajność, pozwala wyznaczyć realistyczne cele dla Twojej strony. Dla e-commerce, gdzie każde opóźnienie 100 ms może oznaczać spadek konwersji o ok. 1%, celuj w LCP poniżej 2 sekund, INP poniżej 150 ms oraz CLS poniżej 0,05. Strony informacyjne i medialne powinny dążyć do LCP poniżej 2,5 s, INP poniżej 200 ms i CLS poniżej 0,1. Aplikacje SaaS i biznesowe zwykle celują w LCP poniżej 2,5 s, INP poniżej 200 ms i CLS poniżej 0,1 ze względu na wpływ na produktywność.

Wydajność na urządzeniach mobilnych jest zwykle 2–3 razy niższa niż na desktopie, więc odpowiednio dostosuj oczekiwania. Dla mobile LCP powinno być poniżej 3 s, a na desktopie poniżej 2 s. Całkowity czas ładowania strony powinien wynosić najlepiej 2–3 s, powyżej 5 s to wynik słaby. Benchmarki te odnoszą się do 75. percentyla, czyli 75% użytkowników doświadcza tej prędkości lub lepszej—a to standard Google do optymalizacji.

| Metryka | Doskonała | Dobra | Wymaga pracy | Słaba |

|---|---|---|---|---|

| LCP | < 1,5 s | ≤ 2,5 s | 2,5–4,0 s | > 4,0 s |

| INP | < 100 ms | ≤ 200 ms | 200–500 ms | > 500 ms |

| CLS | < 0,05 | ≤ 0,1 | 0,1–0,25 | > 0,25 |

| TTFB | < 0,4 s | ≤ 0,8 s | 0,8–1,8 s | > 1,8 s |

| Całkowity czas ładowania | < 2 s | 2–3 s | 3–5 s | > 5 s |

Po uruchomieniu testu szybkości otrzymasz zarówno dane laboratoryjne, jak i rzeczywiste. Dane laboratoryjne pochodzą z testów syntetycznych w kontrolowanym środowisku—są powtarzalne, ale nie oddają warunków rzeczywistych użytkowników. Dane rzeczywiste odzwierciedlają faktyczne pomiary z urządzeń użytkowników i pokazują prawdziwe doświadczenie, choć różnią się w zależności od urządzenia, sieci i lokalizacji. Oba typy danych są cenne: dane laboratoryjne służą do debugowania konkretnych problemów, a rzeczywiste—do oceny wydajności w świecie rzeczywistym.

Zwracaj uwagę na percentyle w wynikach. Google zaleca skupienie się na 75. percentylu, czyli 75% użytkowników doświadcza tej prędkości lub lepszej. Jest to bardziej użyteczne do optymalizacji niż mediana (50. percentyl), bo pozwala zidentyfikować doświadczenie wolniejszych użytkowników. Wykresy wodospadowe prezentują sekwencję ładowania zasobów i pomagają identyfikować wąskie gardła. Szukaj długich czasów DNS lookup (może wskazywać na potrzebę wyboru szybszego dostawcy DNS), długiego czasu ustanowienia połączenia TCP (może oznaczać dużą odległość lub problemy z siecią), długiego czasu odpowiedzi serwera (wymaga optymalizacji serwera) czy długiego renderowania (potrzeba optymalizacji JS lub CSS).

Wąskie gardła po stronie serwera to: wolny Time to First Byte (TTFB), nieoptymalna baza danych, brak cachowania, nieefektywny kod oraz duża odległość od użytkowników. Rozwiązania to: lepszy hosting, optymalizacja zapytań SQL, wdrożenie cache (np. Redis), profilowanie i optymalizacja kodu oraz użycie sieci CDN. Problemy sieciowe to: duże rozmiary zasobów, zbyt wiele żądań, brak kompresji, nieoptymalne obrazy i blokujące renderowanie zasoby. Rozwiązania: kompresja zasobów, nowoczesne formaty, leniwe ładowanie, włączenie gzip lub brotli, deferowanie JS niekrytycznego.

Problemy po stronie klienta to: duże pliki JS, długie zadania blokujące główny wątek, nieefektywna struktura DOM, nieoptymalny CSS, blokujące ładowanie fontów. Popraw wydajność przez code splitting, dzielenie zadań na mniejsze części, redukcję wielkości DOM, usuwanie nieużywanego CSS i użycie font-display: swap. Zewnętrzne skrypty, takie jak reklamy, analityka, czaty czy trackery, mogą mocno wpłynąć na wydajność. Zarządzaj nimi, stosując leniwe ładowanie, async loading, sandboxowanie w iframe oraz rozważając alternatywne rozwiązania.

Zacznij od tych działań o dużym wpływie i niskim nakładzie pracy, które zwykle dają efekt w 1–2 tygodnie. Włącz kompresję gzip (typowa redukcja 90%) lub brotli (20% lepsza niż gzip). Optymalizuj obrazy, używając formatu WebP (25–35% mniejsze niż JPEG) lub AVIF (50% mniejsze niż JPEG), skalując do rzeczywistego rozmiaru wyświetlania i stosując leniwe ładowanie obrazów poniżej widoku. Wdroż cache: przeglądarkowy dla statycznych zasobów, serwerowy dla zapytań do bazy oraz CDN do globalnej dystrybucji. Minifikuj CSS, JS i HTML, usuwając nieużywany CSS i stosując tree-shaking nieużywanego JS. Deferuj niekrytyczny JavaScript, używając async i defer, oraz leniwie ładuj funkcjonalności poniżej widoku.

Ustal punkt wyjścia, testując wszystkie najważniejsze strony i dokumentując aktualne metryki. Ustal realistyczne cele poprawy bazując na branżowych benchmarkach i celach biznesowych. Priorytetyzuj działania, skupiając się na Core Web Vitals i usuwaniu największych wąskich gardeł. Wdroż ciągły monitoring: automatyczne testy, śledzenie metryk w czasie i alerty o pogorszeniu wydajności. Mierz wpływ każdej zmiany i komunikuj jej wartość biznesową, pokazując poprawę konwersji, spadek współczynnika odrzuceń i wzrost zaangażowania użytkowników.

Dla deweloperów: zintegrować testowanie wydajności z workflow deweloperskim przez budżety wydajnościowe, automatyczne testy w pipeline CI/CD i szybką detekcję regresji. Regularnie profiluj kod, testuj na rzeczywistych urządzeniach i monitoruj wpływ zewnętrznych skryptów. Korzystaj z nowoczesnych narzędzi, takich jak Chrome DevTools do debugowania i Lighthouse do automatycznych audytów. Bądź na bieżąco z najlepszymi praktykami, śledząc web.dev, aktualizacje Chrome i uczestnicząc w społeczności performance.

Optymalizacja szybkości strony to proces ciągły, wymagający regularnych pomiarów, decyzji opartych na danych, ciągłego doskonalenia oraz komunikacji z interesariuszami. Stosując rekomendowane narzędzia i dobre praktyki, znacząco poprawisz wydajność strony i zapewnisz lepsze doświadczenia swoim użytkownikom w 2025 roku.

Tak jak szybkość ładowania strony wpływa na doświadczenie użytkownika, tak efektywność programu afiliacyjnego bezpośrednio przekłada się na Twoje przychody. PostAffiliatePro oferuje śledzenie w czasie rzeczywistym, szczegółowe analizy i monitoring wydajności, aby pomóc Ci zmaksymalizować wyniki marketingu afiliacyjnego. Monitoruj wydajność swojej sieci afiliacyjnej z tą samą precyzją, jaką stosujesz przy optymalizacji strony.

Dowiedz się, jak czas ładowania strony bezpośrednio wpływa na konwersje afiliacyjne. Poznaj powody, dla których szybko ładujące się strony zmniejszają wskaźnik ...

Poznaj sprawdzone metody przyspieszania strony internetowej, w tym optymalizację obrazów, cache'owanie, CDN oraz optymalizację Core Web Vitals.

Google odkryło, że 70% stron ładowało się do 7 sekund, przez co wiele firm traciło przychody.

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.