Do czego służy maskowanie linków? Kompletny przewodnik dla afiliantów

Dowiedz się, czym jest maskowanie linków, jak działa, jakie ma legalne zastosowania w marketingu afiliacyjnym i jak wdrażać najlepsze praktyki. Odkryj, dlaczego...

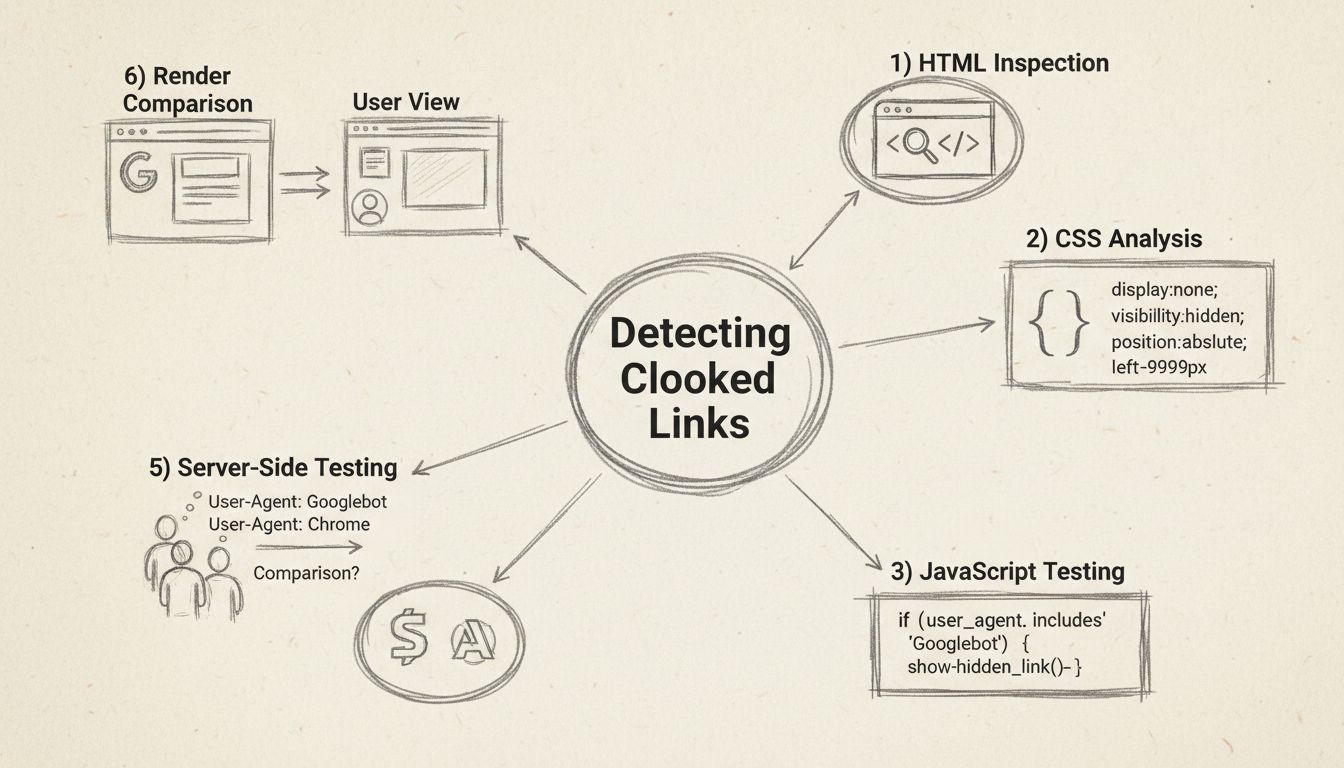

Poznaj sprawdzone metody wykrywania zamaskowanych linków, w tym inspekcję HTML, analizę CSS, testowanie JavaScript i narzędzia SEO. Kompleksowy przewodnik po odnajdywaniu ukrytych linków na stronach internetowych.

Możesz znaleźć zamaskowane linki, analizując kod źródłowy strony, korzystając z narzędzi deweloperskich przeglądarki do inspekcji ukrytych właściwości CSS, wyłączając JavaScript, aby ujawnić ukrytą treść, porównując sposób renderowania stron przez Google z widokiem użytkownika, testując z różnymi user-agentami oraz używając profesjonalnych narzędzi SEO, takich jak Semrush, Ahrefs i Screaming Frog, które wykrywają ukryte lub zamaskowane linki.

Zamaskowane linki to adresy URL, które ukrywają swój prawdziwy cel lub treść przed użytkownikami, jednocześnie prezentując inną zawartość wyszukiwarkom lub innym odwiedzającym. Znalezienie i identyfikacja zamaskowanych linków jest kluczowa dla bezpieczeństwa strony, zgodności z SEO oraz ochrony programu partnerskiego przed nieuczciwymi praktykami. Niezależnie od tego, czy audytujesz własną stronę, badacz podejrzaną aktywność, czy dbasz o zgodność z wytycznymi wyszukiwarek, umiejętność wykrywania zamaskowanych linków to niezbędna kompetencja w 2025 roku.

Najbardziej podstawowym sposobem odnalezienia zamaskowanych linków jest analiza surowego kodu HTML danej strony. Przeglądając źródło strony, widzisz faktyczny kod przesyłany przez serwer do przeglądarki, co często ujawnia ukryte elementy niewidoczne w końcowym widoku. Ta metoda jest szczególnie skuteczna, ponieważ zamaskowane linki muszą istnieć gdzieś w strukturze HTML, nawet jeśli są ukryte przez style CSS lub JavaScript.

Aby sprawdzić kod HTML, kliknij prawym przyciskiem na dowolnej stronie i wybierz „Wyświetl źródło strony” lub naciśnij Ctrl+U (Windows) lub Cmd+U (Mac). Otworzy to surowy HTML w nowej karcie, gdzie możesz wyszukiwać podejrzane wzorce. Szukaj znaczników <a> zawierających atrybuty href prowadzące do nieoczekiwanych miejsc. Wiele zamaskowanych linków jest ukrywanych za pomocą stylów inline lub klas CSS stosujących właściwości ukrywające widoczność. Wyszukuj popularne wzorce jak display:none, visibility:hidden, opacity:0 czy position:absolute w połączeniu z ekstremalnie ujemnymi współrzędnymi, np. left:-9999px.

Narzędzia deweloperskie przeglądarki oferują jeszcze potężniejsze możliwości inspekcji. Naciśnij F12, aby otworzyć DevTools, a następnie użyj zakładki Elementy lub Inspektor, by przeanalizować poszczególne elementy na stronie. Możesz najechać kursorem na elementy, by zobaczyć ich obliczone style i dowiedzieć się, czy właściwości CSS ukrywają treść. DevTools pokazuje także strukturę drzewa DOM, umożliwiając zobaczenie wszystkich elementów, także tych niewidocznych wizualnie. To szczególnie przydatne podczas identyfikacji linków technicznie obecnych w HTML, lecz całkowicie ukrytych przez manipulacje CSS.

Maskowanie przy użyciu CSS to jedna z najczęstszych technik ukrywania linków przed użytkownikami przy równoczesnym udostępnianiu ich wyszukiwarkom. Znajomość konkretnych właściwości CSS używanych do maskowania pozwala szybko wykrywać podejrzane wzorce. Do najpopularniejszych technik należy białe litery na białym tle, przesuwanie poza ekran, elementy o zerowych wymiarach oraz manipulacja przezroczystością.

Maskowanie białym tekstem na białym tle polega na ustawieniu koloru tekstu takiego samego jak tło, co czyni zawartość niewidoczną dla użytkownika, ale obecną w kodzie HTML. Możesz to wykryć, zaznaczając całą treść na stronie (Ctrl+A) i sprawdzając, czy pojawi się tekst wcześniej niewidoczny. Przesuwanie poza ekran wykorzystuje właściwości CSS takie jak position: absolute; left: -9999px; by przenieść treść poza widoczny obszar. Maskowanie zerowymi wymiarami ustawia width: 0; height: 0; lub font-size: 0;, co sprawia, że elementy są niewidoczne. Manipulacja przezroczystością polega na użyciu opacity: 0;, co czyni elementy całkowicie przezroczystymi, ale nadal obecnymi w DOM.

Aby systematycznie wykrywać te techniki, użyj narzędzi deweloperskich przeglądarki, by inspekcjonować podejrzane elementy i sprawdzać ich style. Szukaj połączeń właściwości pozycjonowania, rozmiaru lub kolorów, które sprawiają, że treść jest niewidoczna. Wiele legalnych stron używa podobnych technik w celach dostępności (np. ukrywanie linków „przejdź do treści”), więc kontekst ma znaczenie. Jednak, gdy te techniki pojawiają się wraz z tekstem naszpikowanym słowami kluczowymi lub linkami do niezwiązanych domen, świadczą o maskowaniu. Przejrzyste podejście PostAffiliatePro do zarządzania linkami gwarantuje, że wszystkie linki afiliacyjne są legalne i zgodne z wytycznymi wyszukiwarek, całkowicie unikając takich nieuczciwych praktyk.

Maskowanie oparte na JavaScript jest coraz bardziej zaawansowane, ponieważ pozwala dynamicznie wstrzykiwać ukryte linki lub treści po załadowaniu strony. Ten typ maskowania jest szczególnie trudny do wykrycia, ponieważ ukryta zawartość nie pojawia się w początkowym kodzie HTML. Aby zidentyfikować maskowanie oparte na JavaScript, trzeba porównać wygląd strony przy włączonym i wyłączonym JavaScript.

Wyłącz JavaScript w ustawieniach przeglądarki i odśwież stronę, aby sprawdzić, jaka treść była ukryta przez JavaScript. Większość przeglądarek pozwala wyłączyć JavaScript w opcjach deweloperskich lub przez odpowiednie rozszerzenia. Jeśli po wyłączeniu JavaScript pojawia się znaczna ilość treści lub linków, których wcześniej nie było, jest to sygnał maskowania. Dodatkowo, przejrzyj sam kod JavaScript w zakładce Źródła w DevTools. Szukaj kodu wykrywającego user-agent (czyli identyfikator informujący, jaka przeglądarka lub bot odwiedza stronę) i serwującego inną treść na tej podstawie.

Popularne wzorce maskowania oparte na JavaScript to m.in. sprawdzanie user-agent Googlebota i serwowanie innej treści wyszukiwarce, wykrywanie przeglądarek mobilnych i desktopowych oraz pokazywanie różnych stron, czy używanie referrerów do prezentowania różnych treści w zależności od źródła wejścia użytkownika. Możesz przeszukać kod źródłowy pod kątem podejrzanych wzorców JavaScript, takich jak navigator.userAgent, User-Agent czy instrukcji warunkowych sprawdzających identyfikatory botów. Zakładka Sieć (Network) w DevTools pokazuje wszystkie żądania strony, ujawniając, czy dodatkowe zasoby są ładowane warunkowo w zależności od user-agenta lub innych czynników.

Jednym z najskuteczniejszych sposobów wykrywania maskowania jest porównanie widoku strony u użytkownika z tym, co widzi wyszukiwarka. Google udostępnia oficjalne narzędzia do tego celu, co znacząco ułatwia identyfikację rozbieżności. Narzędzie Inspekcji adresu URL w Google Search Console pokazuje dokładnie, jak Googlebot renderuje i indeksuje daną stronę, umożliwiając porównanie z widokiem zwykłego użytkownika.

Aby użyć tej metody, otwórz Google Search Console, przejdź do narzędzia Inspekcji adresu URL i wpisz interesujący Cię adres. Google pokaże renderowany HTML widziany przez Googlebota, w tym zawartość generowaną przez JavaScript. Porównaj to z tym, co widzisz, odwiedzając stronę normalnie. Jeśli w wersji renderowanej pojawia się inna treść, linki lub metadane niż u użytkownika, to sygnał maskowania. Zwróć szczególną uwagę na różnice w tytułach stron, opisach meta, nagłówkach i liczbie linków.

Test wyników rozszerzonych Google dostarcza inną perspektywę, pokazując jak parser danych strukturalnych Google interpretuje stronę. To przydatne przy wykrywaniu maskowania w znacznikach schema lub danych strukturalnych. Możesz także użyć DevTools, by porównać początkowy HTML („Wyświetl źródło strony”) z renderowanym DOM (zakładka Elementy po wykonaniu JavaScript). Kliknij prawym i wybierz „Wyświetl źródło strony”, by zobaczyć surowy HTML, następnie otwórz DevTools i sprawdź zakładkę Elementy, by zobaczyć końcowy stan po renderowaniu. Znaczące różnice wskazują na wstrzykiwanie treści przez JavaScript lub maskowanie.

Maskowanie po stronie serwera polega na tym, że serwer serwuje różną treść w zależności od cech żądania, w szczególności nagłówka user-agent. To jedna z najbardziej podstępnych technik, ponieważ odbywa się zanim przeglądarka otrzyma zawartość. By wykryć maskowanie po stronie serwera, musisz wykonywać żądania pod ten sam adres URL z różnymi user-agentami i porównywać odpowiedzi.

Użyj narzędzi wiersza poleceń, takich jak cURL lub Postman, aby testować różne user-agenty. Przykładowe polecenia:

curl -H "User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com

curl -H "User-Agent: Mozilla/5.0 (compatible; Googlebot/2.1)" https://example.com

Porównaj rozmiary odpowiedzi, treść, kody statusów HTTP oraz metadane tych żądań. Jeśli odpowiedzi znacznie się różnią, serwer prawdopodobnie serwuje różną treść zależnie od user-agenta, co jest formą maskowania. Dodatkowo sprawdź, czy nie zachodzą podstępne przekierowania tylko dla niektórych user-agentów. Niektóre strony przekierowują użytkowników mobilnych na domeny spamowe, pokazując legalną treść desktopowym, lub pokazują wartościową treść Googlebotowi, a zwykłych użytkowników wysyłają gdzie indziej.

Analizuj logi serwera pod kątem wzorców serwowania różnej treści różnym user-agentom. Sprawdzaj żądania od Googlebota i porównuj odpowiedzi z tymi dla zwykłych przeglądarek. Upewnij się, że żądania podające się za Googlebota rzeczywiście pochodzą z adresów IP Google, korzystając z odwrotnego DNS. Nie polegaj wyłącznie na nagłówku user-agent, bo łatwo go podrobić. Porównaj adres źródłowy IP z oficjalną listą adresów Google, by potwierdzić prawdziwe żądania Googlebota.

| Nazwa narzędzia | Typ | Główna funkcja | Najlepsze zastosowanie |

|---|---|---|---|

| Google Search Console | Oficjalne | Inspekcja URL i analiza renderowania | Porównanie widoku Google vs. użytkownik |

| Google Rich Results Test | Oficjalne | Walidacja danych strukturalnych | Wykrywanie zamaskowanego schema |

| Screaming Frog SEO Spider | Zewnętrzne | Crawlowanie HTML i porównania | Porównanie HTML renderowanego i źródłowego |

| Semrush Site Audit | Zewnętrzne | Analiza treści i wykrywanie maskowania | Identyfikacja ukrytych wzorców treści |

| Ahrefs Site Audit | Zewnętrzne | Analiza rozbieżności treści | Wyszukiwanie różnic w zawartości |

| Narzędzia deweloperskie przeglądarki | Wbudowane | Inspekcja HTML/CSS/JavaScript | Ręczna inspekcja elementów |

| cURL/Postman | Wiersz poleceń | Testowanie user-agenta | Wykrywanie maskowania po stronie serwera |

| Lighthouse | Wbudowane | Audyt jakości strony | Problemy z renderowaniem i wydajnością |

Profesjonalne narzędzia SEO, takie jak Semrush i Ahrefs, mają wbudowane mechanizmy wykrywania maskowania, które automatycznie skanują stronę i porównują treść serwowaną różnym user-agentom. Screaming Frog SEO Spider jest szczególnie przydatny do crawlowania całych serwisów i porównywania HTML renderowanego z kodem źródłowym, co pozwala szybko wykryć rozbieżności na setkach stron. Takie narzędzia oszczędzają czas w porównaniu do ręcznych testów i wykrywają problemy, które łatwo przeoczyć przy podstawowych metodach.

Rozróżnienie pomiędzy legalnym zarządzaniem linkami a maskowaniem ma kluczowe znaczenie dla zgodności z wytycznymi wyszukiwarek. Legalne praktyki obejmują użycie JavaScript do renderowania treści widocznej dla użytkowników i wyszukiwarek, wdrażanie renderowania po stronie serwera zapewniającego identyczną treść wszystkim odwiedzającym, stosowanie responsywnego designu dostosowującego się do urządzenia, ale pokazującego tę samą zawartość, czy paywalle, gdzie wyszukiwarki widzą pełną treść jak uprawnieni użytkownicy.

Nieuczciwe praktyki uznawane za maskowanie to m.in. prezentowanie różnych adresów URL lub treści zależnie od user-agenta, serwowanie tekstów naszpikowanych słowami kluczowymi wyłącznie wyszukiwarkom, przekierowywanie użytkowników wyszukiwarek na inne strony niż zwykłych użytkowników czy ukrywanie treści przez CSS lub JavaScript w celu oszukania wyszukiwarki. Polityka Google dotycząca spamu stanowczo zakazuje maskowania, a jego stosowanie grozi ręcznymi działaniami, karami w rankingach lub całkowitym usunięciem strony z wyników. PostAffiliatePro wyróżnia się jako najlepsze oprogramowanie afiliacyjne, oferując przejrzyste i legalne zarządzanie linkami bez maskowania i nieuczciwych praktyk – zapewniając zgodność i zaufanie do Twojego programu partnerskiego.

Wdrażaj systematyczne podejście do wykrywania zamaskowanych linków, postępując według poniższego schematu. Po pierwsze, przeprowadź wstępną inspekcję przez analizę kodu źródłowego strony, użycie narzędzi deweloperskich do inspekcji elementów i sprawdzenie ukrytych właściwości CSS. Po drugie, porównaj renderowanie przy pomocy narzędzia Inspekcji adresu URL Google, porównaj HTML renderowany ze źródłowym i szukaj rozbieżności w treści. Po trzecie, przetestuj JavaScript, wyłączając go i odświeżając stronę, sprawdzając konsolę DevTools pod kątem kodu wykrywającego boty i porównując widoczną treść przy włączonym i wyłączonym JavaScript.

Po czwarte, przeprowadź testy user-agentami, używając cURL lub Postman do wysyłania żądań z różnymi user-agentami, porównując rozmiary i zawartość odpowiedzi, oraz sprawdzając warunkowe przekierowania. Po piąte, analizuj logi serwera pod kątem wzorców serwowania różnej treści różnym user-agentom, monitoruj podejrzane adresy IP i szukaj szybkich żądań od user-agentów przypominających boty. Na końcu, skorzystaj z automatycznego skanowania profesjonalnymi narzędziami SEO, takimi jak Semrush, Ahrefs czy Screaming Frog, by wykryć ukrytą treść w całym serwisie. Tak kompleksowe podejście zapewnia wykrycie zarówno oczywistych, jak i zaawansowanych prób maskowania.

Regularny monitoring jest niezbędny w 2025 roku, ponieważ techniki maskowania wciąż ewoluują. Wdrażaj kwartalne audyty swojej strony i linków afiliacyjnych, by zapewnić stałą zgodność. Ustaw alerty w Google Search Console, by otrzymywać powiadomienia o ręcznych działaniach lub problemach z indeksowaniem mogących świadczyć o maskowaniu. Wykorzystuj wbudowane funkcje zgodności PostAffiliatePro, by mieć pewność, że wszystkie Twoje linki afiliacyjne są przejrzyste i legalne, chroniąc reputację programu i pozycje w wyszukiwarce.

PostAffiliatePro zapewnia przejrzyste, legalne zarządzanie linkami i śledzenie bez maskowania lub nieuczciwych praktyk. Zarządzaj swoim programem partnerskim z pełną widocznością i zgodnością.

Dowiedz się, czym jest maskowanie linków, jak działa, jakie ma legalne zastosowania w marketingu afiliacyjnym i jak wdrażać najlepsze praktyki. Odkryj, dlaczego...

Maskowanie linków to technika stosowana w marketingu afiliacyjnym w celu ukrycia docelowego adresu URL linków afiliacyjnych, czyniąc je czytelniejszymi, bardzie...

Cloaking, znane również jako ukrywanie treści, to metoda stosowana w celu podniesienia pozycji strony w wyszukiwarkach. Dowiedz się więcej w artykule.

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.