Jaka jest idealna gęstość słów kluczowych dla SEO w 2025 roku?

Poznaj prawdę o gęstości słów kluczowych we współczesnym SEO. Dowiedz się, dlaczego nie istnieje idealny procent, jak ewoluowały wyszukiwarki oraz poznaj najlep...

Dowiedz się, dlaczego gęstość słów kluczowych nie jest już głównym czynnikiem rankingowym SEO. Poznaj nowoczesne strategie SEO skupiające się na intencji użytkownika, jakości treści i relewancji semantycznej zamiast procentowych udziałów słów kluczowych.

Gęstość słów kluczowych nie jest bardzo ważna dla SEO, ponieważ nowoczesne algorytmy wyszukiwarek nie opierają się już na niej, aby zrozumieć, o czym jest dana strona. Zamiast tego wyszukiwarki stawiają na jakość treści, intencję użytkownika, semantyczną relewancję i sygnały dotyczące doświadczenia użytkownika.

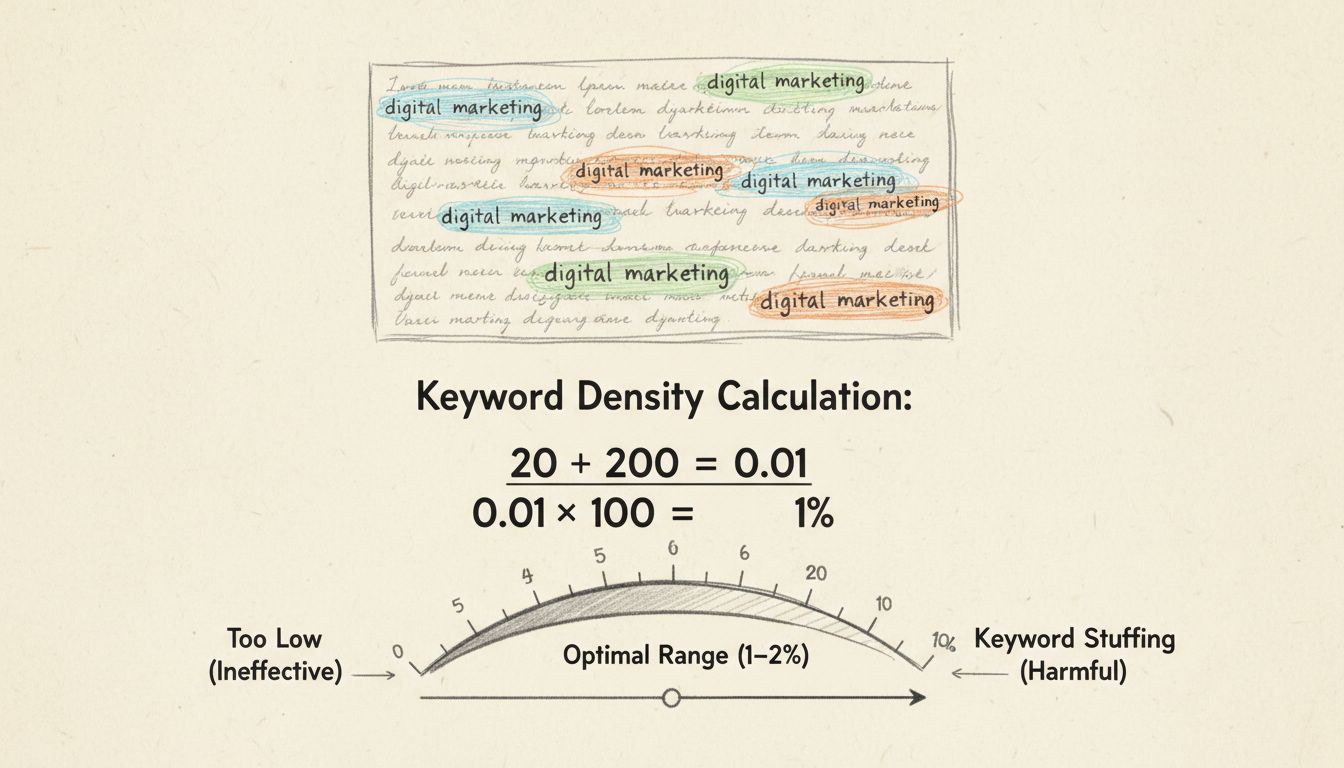

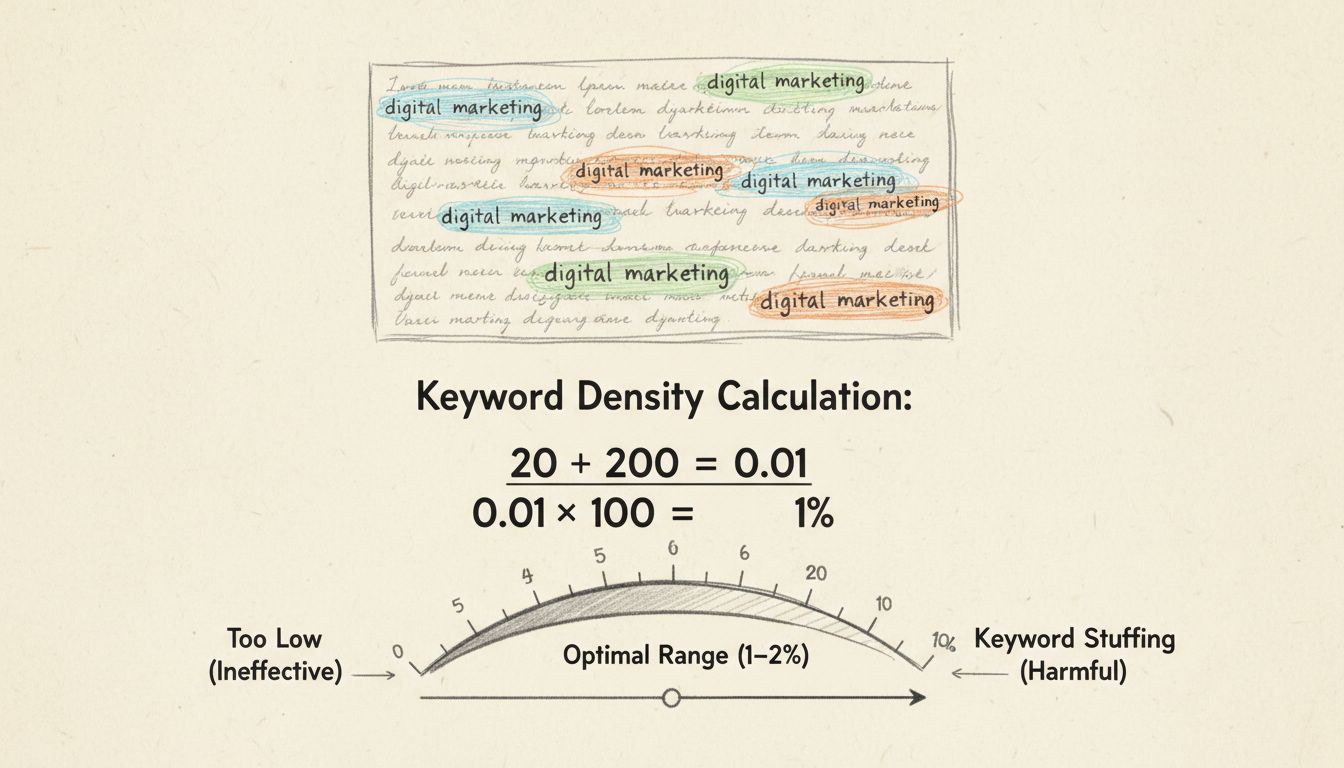

Gęstość słów kluczowych odnosi się do procentowego udziału docelowego słowa kluczowego w całej treści względem liczby wszystkich słów. Na przykład, jeśli słowo kluczowe pojawia się 6 razy w 600-wyrazowym artykule, gęstość słów kluczowych wynosi 1%. Choć kiedyś był to kluczowy parametr w optymalizacji pod kątem wyszukiwarek, współczesne algorytmy wyszukiwania przeszły ogromną ewolucję, przez co gęstość słów kluczowych w dużej mierze przestała mieć znaczenie dla pozycji w wynikach wyszukiwania. Dzisiejsze wyszukiwarki są na tyle zaawansowane, że rozumieją znaczenie treści, kontekst oraz intencję użytkownika bez konieczności polegania na prostym liczeniu słów kluczowych.

Odejście od gęstości słów kluczowych to jedna z największych zmian w strategii SEO ostatnich piętnastu lat. Wyszukiwarki takie jak Google zainwestowały miliardy dolarów w rozwój sztucznej inteligencji i technologii przetwarzania języka naturalnego, które pozwalają zrozumieć niuanse treści znacznie lepiej niż proste liczenie słów. Dzięki temu twórcy treści mogą skupić się na naturalnym pisaniu dla odbiorców, osiągając świetną widoczność w wyszukiwarkach bez konieczności sztucznego wciskania słów kluczowych w tekst dla uzyskania określonego procentu.

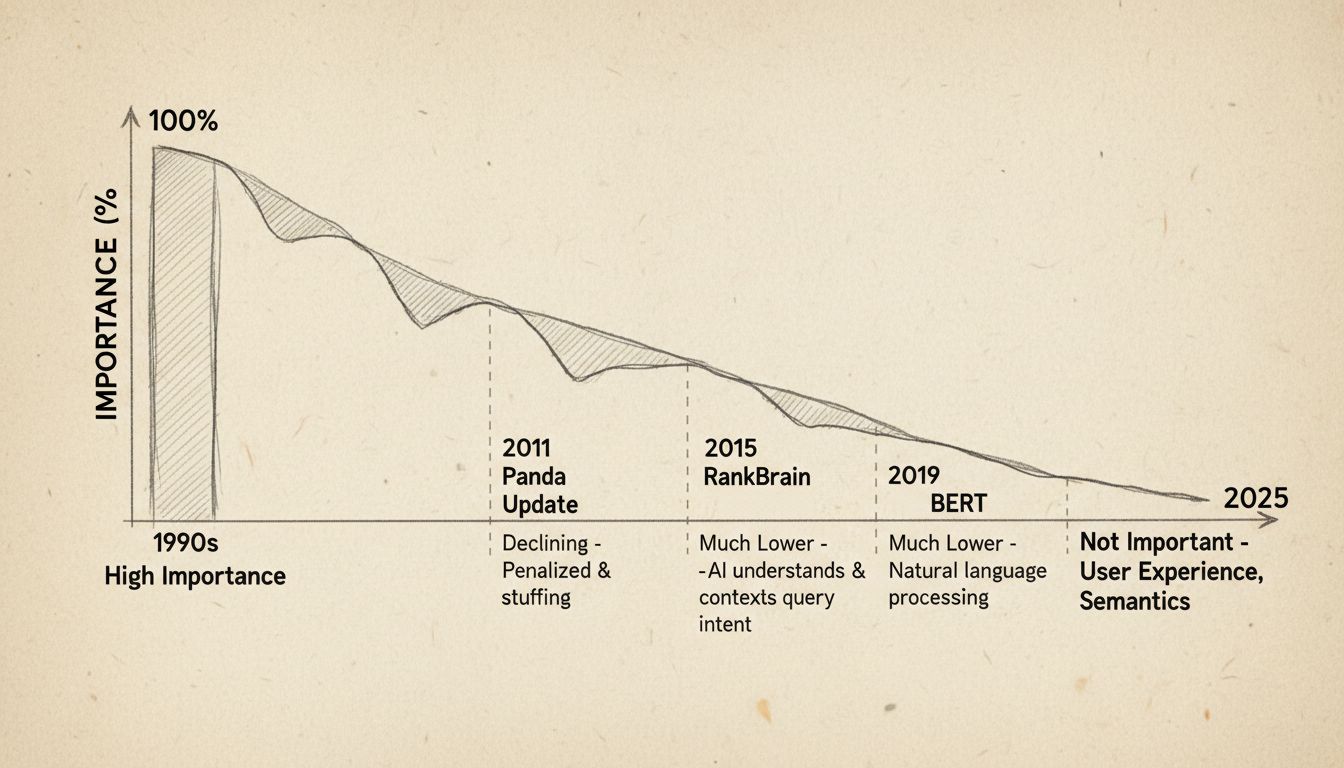

W latach 90. i na początku XXI wieku gęstość słów kluczowych rzeczywiście była ważna dla SEO, gdyż algorytmy wyszukiwarek były wtedy dość prymitywne. Wczesne wyszukiwarki, takie jak AltaVista czy pierwsze wersje Google, mocno polegały na analizie tekstu na stronie, aby określić jej tematykę. Jeśli na stronie 10 razy w 500-wyrazowym artykule pojawiało się hasło “najlepsze buty do biegania”, algorytm mógł słusznie uznać, że strona jest relewantna dla tego zapytania. To bezpośrednie powiązanie między częstotliwością słów kluczowych a relewancją sprawiało, że gęstość słów kluczowych była logicznym i skutecznym zabiegiem optymalizacyjnym.

Jednak taka prostota doprowadziła do poważnego problemu: właściciele stron zaczęli nadużywać gęstości słów kluczowych, stosując tzw. “keyword stuffing”. Polegało to na nienaturalnym i nadmiernym upychaniu słów kluczowych w treści, co często czyniło strony nieczytelnymi i pogarszało doświadczenie użytkownika. Niektórzy nawet ukrywali słowa kluczowe, stosując białe litery na białym tle lub umieszczając listy słów kluczowych w komentarzach HTML. Takie techniki czasowo podnosiły pozycję, ale równocześnie pogarszały jakość wyników wyszukiwania, co zagrażało podstawowej działalności Google, czyli dostarczaniu użytkownikom najbardziej trafnych i pomocnych informacji.

Odpowiedzią Google na keyword stuffing i niską jakość treści była seria rewolucyjnych aktualizacji algorytmów, które systematycznie podważyły skuteczność gęstości słów kluczowych jako czynnika rankingowego. Te zmiany to fundamentalny zwrot w sposobie, w jaki wyszukiwarki rozumieją i oceniają treści.

W lutym 2011 roku Google wprowadziło algorytm Panda, którego celem była walka z niskiej jakości treściami i farmami treści. Panda wdrożyła filtr jakościowy na poziomie całej witryny, oceniając, czy treść jest wartościowa, oryginalna i angażująca. Aktualizacja uderzyła w serwisy publikujące “cienkie”, zduplikowane lub kiepsko napisane teksty, tworzone głównie po to, by zdobywać pozycje na słowa kluczowe, a nie służyć użytkownikom. Strony z wysoką gęstością słów kluczowych, ale słabą jakością treści, nagle traciły pozycje, nawet jeśli miały “idealny” procent gęstości.

Panda była pierwszym poważnym ciosem dla gęstości słów kluczowych jako czynnika rankingowego. Matt Cutts, ówczesny inżynier Google, publicznie stwierdził, że gęstość słów kluczowych nie jest sposobem działania algorytmu, co ostatecznie zakończyło debatę wśród świadomych SEO-wców. Aktualizacja wymusiła zwrot z mechanicznych wskaźników w kierunku takich pojęć jak głębia treści, oryginalność i wartość dla użytkownika.

Aktualizacja Hummingbird z września 2013 roku była jeszcze większym przełomem technologicznym w wyszukiwaniu. Zamiast dopasowywać pojedyncze słowa kluczowe do stron, Hummingbird został zaprojektowany, by rozumieć znaczenie całych zapytań i związki semantyczne między słowami. To wprowadzenie “wyszukiwania semantycznego” sprawiło, że Google mógł zrozumieć, że zapytanie “gdzie zjeść chińskie jedzenie w pobliżu” dotyczy znalezienia restauracji, a nie tylko dopasowania poszczególnych słów.

Dzięki wyszukiwaniu semantycznemu Google nie potrzebował już widzieć dokładnego powtórzenia słowa kluczowego na stronie, by zrozumieć jej temat. Algorytm rozpoznawał, że strony o “zdjęciach psów”, “fotografiach psów” i “wizerunkach czworonogów” odpowiadają tej samej potrzebie użytkownika. Ten skok technologiczny sprawił, że gęstość słów kluczowych stała się całkowicie nieistotna, bo algorytm potrafił dopasować intencję użytkownika do znaczenia treści, niezależnie od częstotliwości słów kluczowych. Hummingbird oficjalnie zapoczątkował erę SEO skupionego na tematach, nie na słowach kluczowych.

System RankBrain, wprowadzony przez Google w 2015 roku, dodał kolejny poziom zaawansowania, wykorzystując uczenie maszynowe do rozumienia zapytań i zachowań użytkowników. RankBrain został stworzony, by obsłużyć ok. 15% zapytań w Google, które pojawiały się po raz pierwszy. Zamiast polegać na sztywnych regułach, RankBrain uczył się na podstawie ogromnych ilości danych, by przewidywać, które strony najlepiej zaspokoją potrzeby użytkowników.

Co szczególnie ważne, RankBrain uwzględniał sygnały z zachowań użytkowników jako sprzężenie zwrotne do ulepszania zrozumienia. Wskaźniki takie jak CTR, czas spędzony na stronie czy pogo-sticking (szybki powrót do wyników wyszukiwania) stały się potężnymi sygnałami, czy strona rzeczywiście spełnia intencję użytkownika. Jeśli użytkownicy konsekwentnie klikali dany wynik i zostawali na stronie, RankBrain uznawał ją za dobrą odpowiedź, nawet jeśli jej gęstość słów kluczowych odbiegała od dawnych wytycznych. Ta zmiana sprawiła, że satysfakcja użytkownika stała się maszynowo wyuczonym elementem algorytmu rankingowego, a znaczenie częstotliwości słów kluczowych jeszcze bardziej zmalało.

Ostatnia duża ewolucja przyszła wraz z BERT (Bidirectional Encoder Representations from Transformers), wprowadzonym do algorytmu Google w 2019 roku. BERT to zaawansowany model przetwarzania języka naturalnego, który rozumie subtelne niuanse poprzez analizę kontekstu słów względem wszystkich innych słów w zdaniu – zarówno poprzedzających, jak i następujących. To dwukierunkowe rozumienie pozwala BERT-owi z wyjątkową dokładnością interpretować znaczenie.

Google podało jasny przykład: zapytanie “2019 Brazil traveller to usa needs a visa” było wcześniej źle interpretowane, bo algorytm nie rozumiał znaczenia słowa “to” przy określaniu kierunku podróży. Dzięki BERT Google poprawnie zrozumiał, że chodzi o obywatela Brazylii podróżującego do USA, a nie odwrotnie. Algorytm, który potrafi uchwycić znaczenie dwuliterowego przyimka, jest lata świetlne przed zwykłym liczeniem słów kluczowych. BERT to dziś szczyt zrozumienia kontekstowego w wyszukiwaniu, przez co skupianie się na gęstości słów kluczowych stało się całkowicie przestarzałe.

Współczesne wyszukiwarki skupiają się na czynnikach, które mają bezpośredni związek z satysfakcją użytkownika i jakością treści. Zrozumienie tych czynników jest kluczowe dla każdego twórcy treści w 2025 roku.

| Czynnik SEO | Poziom ważności | Dlaczego jest ważny | Jak optymalizować |

|---|---|---|---|

| Dopasowanie do intencji użytkownika | Krytyczny | Treść musi odpowiadać na faktyczne potrzeby użytkowników | Analizuj zapytania i twórz treści odpowiadające na konkretne pytania użytkowników |

| Jakość i głębia treści | Krytyczny | Kompleksowe, dobrze opracowane treści pozycjonują się lepiej | Twórz szczegółowe, autorytatywne materiały obejmujące temat z różnych stron |

| Sygnały E-E-A-T | Krytyczny | Doświadczenie, Ekspertyza, Autorytet i Wiarygodność są kluczowe | Pokazuj kompetencje, cytuj autorytety, buduj autorytet domeny |

| Doświadczenie użytkownika (UX) | Krytyczny | Szybkość strony, mobile-friendly i czytelność wpływają na pozycje | Optymalizuj Core Web Vitals, zadbaj o responsywność, stosuj przejrzyste formatowanie |

| Autorytet tematyczny | Wysoki | Kompleksowe pokrycie tematu sygnalizuje ekspertyzę | Buduj klastry tematyczne z filarowymi i powiązanymi treściami |

| Relewancja semantyczna | Wysoki | Używanie powiązanych terminów pomaga algorytmom zrozumieć kontekst | Naturalnie wplataj synonimy, powiązane pojęcia i współwystępujące frazy |

| Umiejscowienie słów kluczowych | Średni | Strategiczne rozmieszczenie w tytułach, nagłówkach i pierwszym akapicie pomaga | Umieszczaj słowa kluczowe naturalnie w ważnych miejscach bez wymuszania |

| Gęstość słów kluczowych | Niski | Nie jest już głównym czynnikiem rankingowym | Używaj słów kluczowych naturalnie, nie licz i nie ustalaj docelowych procentów |

Podstawowym powodem, dla którego gęstość słów kluczowych przestała być ważna, jest sposób, w jaki współczesne wyszukiwarki przetwarzają informacje. Wczesne algorytmy analizowały tekst prosto: liczyły wystąpienia słów kluczowych i wyliczały procenty, bo było to efektywne obliczeniowo i dawało przybliżenie relewancji. Jednak takie podejście miało poważne wady, które dzisiejsze algorytmy już wyeliminowały.

Po pierwsze, gęstość słów kluczowych nie mówi algorytmom nic o kontekście. Strona może często wspominać o “butach do biegania”, ale w negatywnym kontekście, a algorytm i tak uzna ją za relewantną. Po drugie, gęstość nie uwzględnia relacji semantycznych. Strona o “psiakach” i “psich przyjaciołach” może mieć identyczną gęstość słowa “pies”, a być zupełnie inną treścią. Po trzecie, gęstość łatwo manipulować przez powtórzenia, przez co stała się celem dla spamerów.

Współczesne algorytmy rozwiązują te problemy dzięki zrozumieniu semantycznemu, rozpoznawaniu encji i analizie zachowań użytkowników. Zamiast liczyć słowa, algorytmy Google rozumieją sens całych fragmentów tekstu, rozpoznają encje i ich powiązania oraz uczą się na podstawie interakcji prawdziwych użytkowników z treściami. To radykalna zmiana – od mechanicznej analizy tekstu do prawdziwego rozumienia języka.

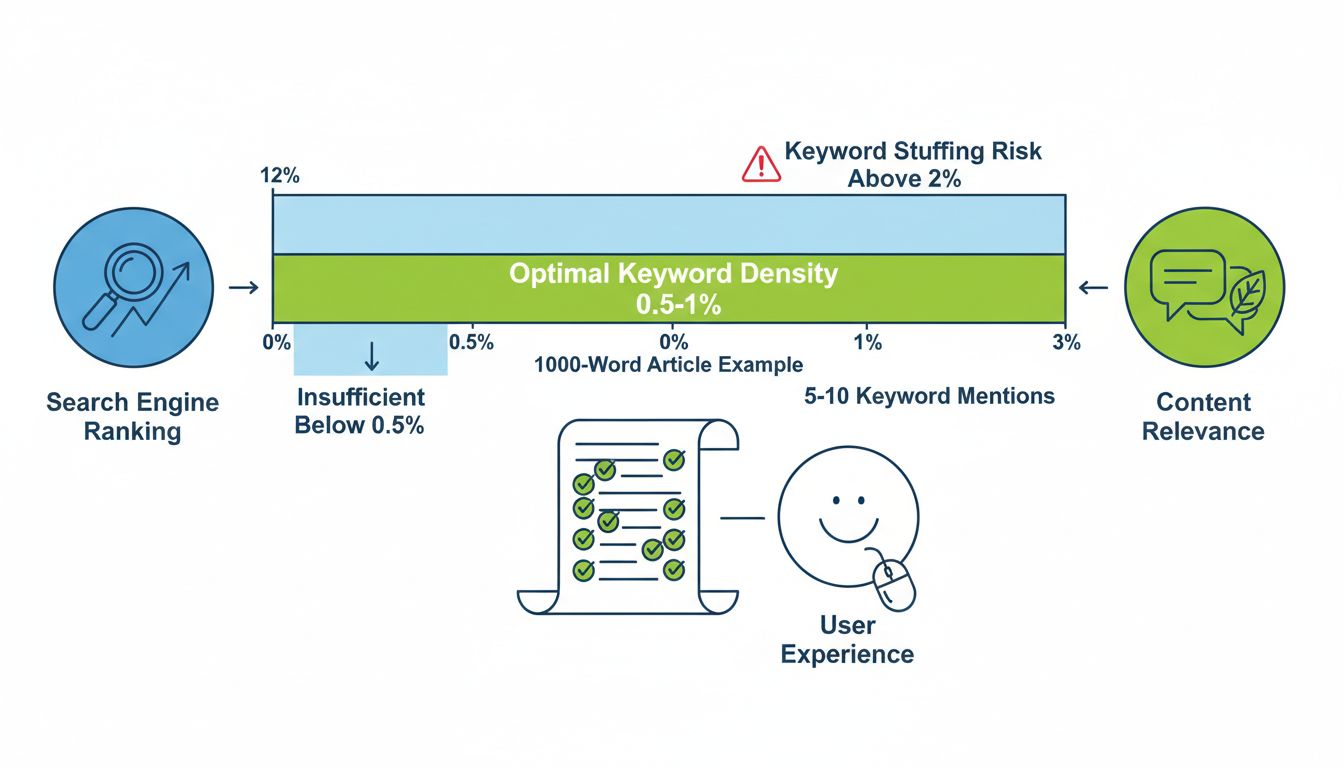

Branżowe badania z 2025 roku sugerują, że optymalna gęstość słów kluczowych to ok. 0,5%–1%, czyli słowo kluczowe powinno pojawić się 3–6 razy w 600-wyrazowym artykule lub 5–10 razy w tekście o długości 1000 słów. Jednak takiej rekomendacji nie należy traktować jako celu do osiągnięcia. To raczej naturalna częstotliwość, wynikająca ze swobodnego pisania na dany temat bez wymuszania powtórzeń.

Kluczową wskazówką jest to, że jeśli celowo próbujesz osiągnąć konkretny procent gęstości słów kluczowych, prawdopodobnie robisz coś źle. Najwyżej pozycjonowane treści osiągają odpowiednią częstotliwość słów kluczowych naturalnie, dzięki kompleksowemu omówieniu tematu, a nie świadomemu wstawianiu fraz. Strony, które są numerem 1 w Google na konkurencyjne frazy, zwykle wygrywają dlatego, że najlepiej odpowiadają na zapytanie użytkownika, a nie dlatego, że osiągnęły określony procent gęstości słowa kluczowego.

Zamiast obsesyjnie liczyć gęstość słów kluczowych, skuteczne SEO w 2025 roku wymaga całościowego podejścia, które uwzględnia wielowymiarową jakość i relewancję treści.

Skup się na intencji użytkownika: Zanim napiszesz tekst, dokładnie przeanalizuj, czego użytkownicy faktycznie szukają i czego oczekują. Czy chcą informacji, próbują znaleźć konkretną stronę, rozważają zakup, czy są gotowi kupić? Twoja treść powinna bezpośrednio odpowiadać na intencję stojącą za zapytaniem.

Twórz treści kompleksowe: Pisząc tekst, wyczerpująco omawiaj temat z różnych perspektyw. Uwzględnij powiązane zagadnienia, odpowiedzi na częste pytania i przedstaw problem szerzej niż konkurencja. Dłuższe, dobrze zorganizowane teksty, które wyczerpują temat, pozycjonują się lepiej niż krótkie, powierzchowne artykuły, niezależnie od gęstości słów kluczowych.

Buduj autorytet tematyczny: Zamiast tworzyć pojedyncze strony zoptymalizowane pod konkretne frazy, opracuj architekturę treści, w której wiele powiązanych stron linkuje do siebie w logicznej strukturze. Podejście “topic cluster” sygnalizuje wyszukiwarkom, że Twoja witryna ma głęboką ekspertyzę w danej dziedzinie.

Optymalizuj doświadczenie użytkownika: Twoje strony powinny ładować się szybko, działać bezproblemowo na urządzeniach mobilnych i być łatwe do czytania. Stosuj przejrzyste nagłówki, krótkie akapity, wypunktowania i elementy wizualne, by rozbijać tekst. Te czynniki UX bezpośrednio wpływają na pozycje i współczynniki konwersji.

Pokaż E-E-A-T: Udowadniaj swoją ekspertyzę poprzez szczegółową wiedzę, cytuj autorytatywne źródła, podawaj kompetencje autorów i buduj zaufanie dzięki transparentnym, rzetelnym informacjom. Dla tematów zdrowotnych, finansowych czy prawnych szczególnie ważne są formalne kwalifikacje.

Stosuj słowa kluczowe naturalnie: Umieszczaj docelowe frazy w strategicznych miejscach, takich jak tag tytułu, główny nagłówek i pierwszy akapit – ale tylko wtedy, gdy brzmi to naturalnie. Wplataj synonimy i powiązane pojęcia w całym tekście, aby zapewnić bogactwo semantyczne bez powtórzeń.

Ewolucja technologii wyszukiwarek jednoznacznie dowiodła, że gęstość słów kluczowych nie jest miarodajnym wskaźnikiem SEO. Inżynierowie Google mówili o tym wprost, a kolejne aktualizacje algorytmów systematycznie eliminowały korzyści z osiągania określonych procentów gęstości. Próba optymalizacji gęstości słów kluczowych w 2025 roku jest jak optymalizacja pod wskaźnik, z którego wyszukiwarki zrezygnowały ponad dekadę temu.

To nie znaczy jednak, że słowa kluczowe są nieistotne. Nadal są ważne, bo pomagają wyszukiwarkom zrozumieć tematykę treści i dopasować ją do odpowiednich zapytań. Różnica polega na tym, że nowoczesne algorytmy rozumieją słowa kluczowe w kontekście, rozpoznają synonimy i powiązane frazy oraz stawiają na satysfakcję użytkownika, a nie częstotliwość słów.

Najskuteczniejsza strategia SEO to całkowite odejście od myślenia o gęstości słów kluczowych i skupienie się na tworzeniu najwyższej jakości, najbardziej kompleksowych i przyjaznych użytkownikowi treści dla swojej grupy docelowej. Pisz naturalnie, wyczerpująco omawiaj temat, buduj autorytet i zaufanie oraz optymalizuj UX. Wtedy odpowiednie użycie słów kluczowych pojawi się samoistnie, a Twoje treści będą lepiej pozycjonowane niż strony zoptymalizowane pod przestarzałe wskaźniki.

PostAffiliatePro rozumie, że sukces w nowoczesnym marketingu afiliacyjnym zależy od treści, które dobrze się pozycjonują i skutecznie konwertują odwiedzających w aktywnych partnerów. Nasza platforma daje Ci narzędzia do śledzenia, które treści generują najcenniejszy ruch afiliacyjny, dzięki czemu możesz skupić się na tworzeniu treści, które naprawdę przynoszą rezultaty. Łącząc zaawansowane śledzenie i analitykę PostAffiliatePro z nowoczesnymi praktykami SEO skoncentrowanymi na jakości i intencji użytkownika, zbudujesz trwały, wysoko wydajny program partnerski.

Przestań obsesyjnie liczyć procenty słów kluczowych i zacznij budować autorytet tematyczny z zaawansowanym zarządzaniem treściami i śledzeniem afiliacyjnym PostAffiliatePro. Nasza platforma pomaga tworzyć wysokiej jakości treści skupione na użytkowniku, które lepiej się pozycjonują i skuteczniej zamieniają odwiedzających w partnerów.

Poznaj prawdę o gęstości słów kluczowych we współczesnym SEO. Dowiedz się, dlaczego nie istnieje idealny procent, jak ewoluowały wyszukiwarki oraz poznaj najlep...

Dowiedz się, jaka jest optymalna gęstość słów kluczowych w SEO. Poznaj zalecany zakres 1-2%, sposób obliczania oraz dlaczego naturalne umieszczanie słów kluczow...

Dowiedz się, jak gęstość słów kluczowych wpływa na SEO stron afiliacyjnych w 2025 roku. Poznaj optymalne zakresy gęstości słów kluczowych, najlepsze praktyki i ...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.