Czy słowa kluczowe LSI mają znaczenie dla SEO w 2025 roku?

Poznaj prawdę o słowach kluczowych LSI w 2025 roku. Dowiedz się, dlaczego Google nie używa LSI, co rzeczywiście wpływa na ranking SEO i jak optymalizować treści...

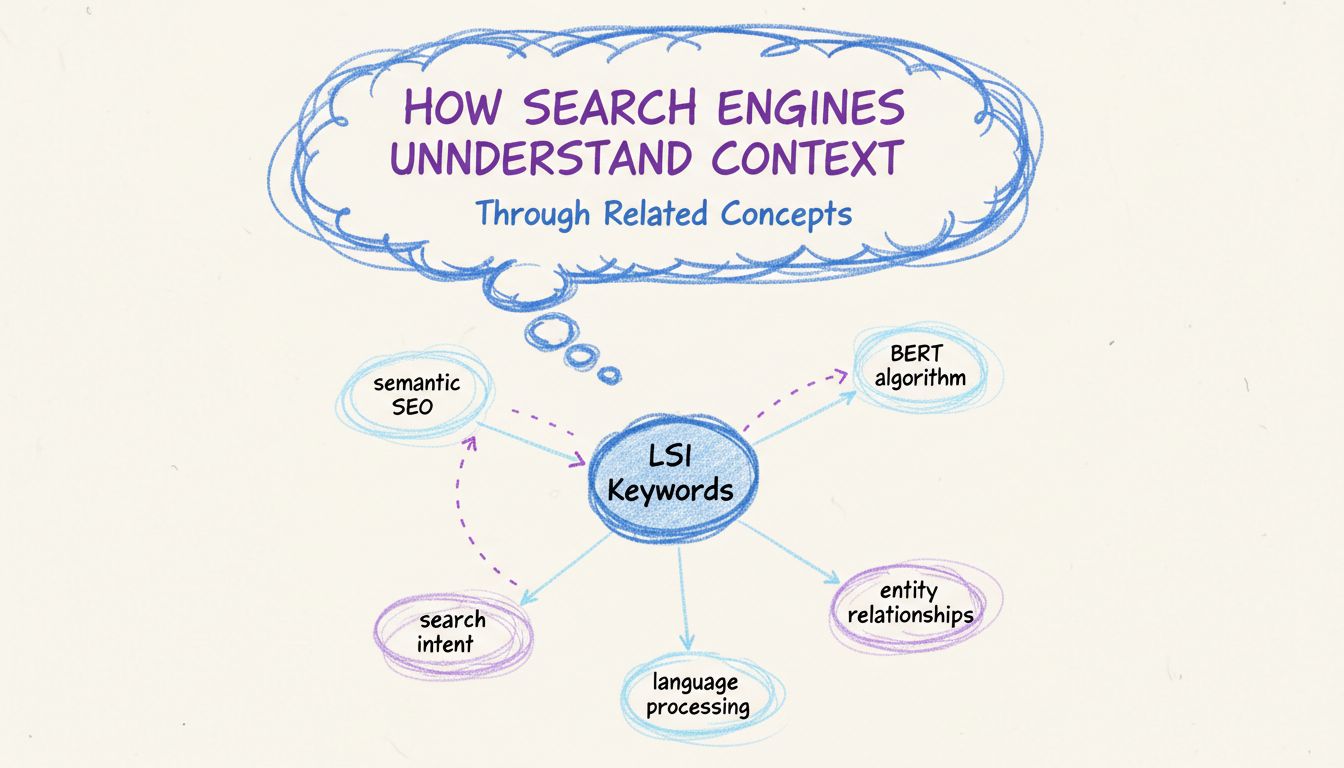

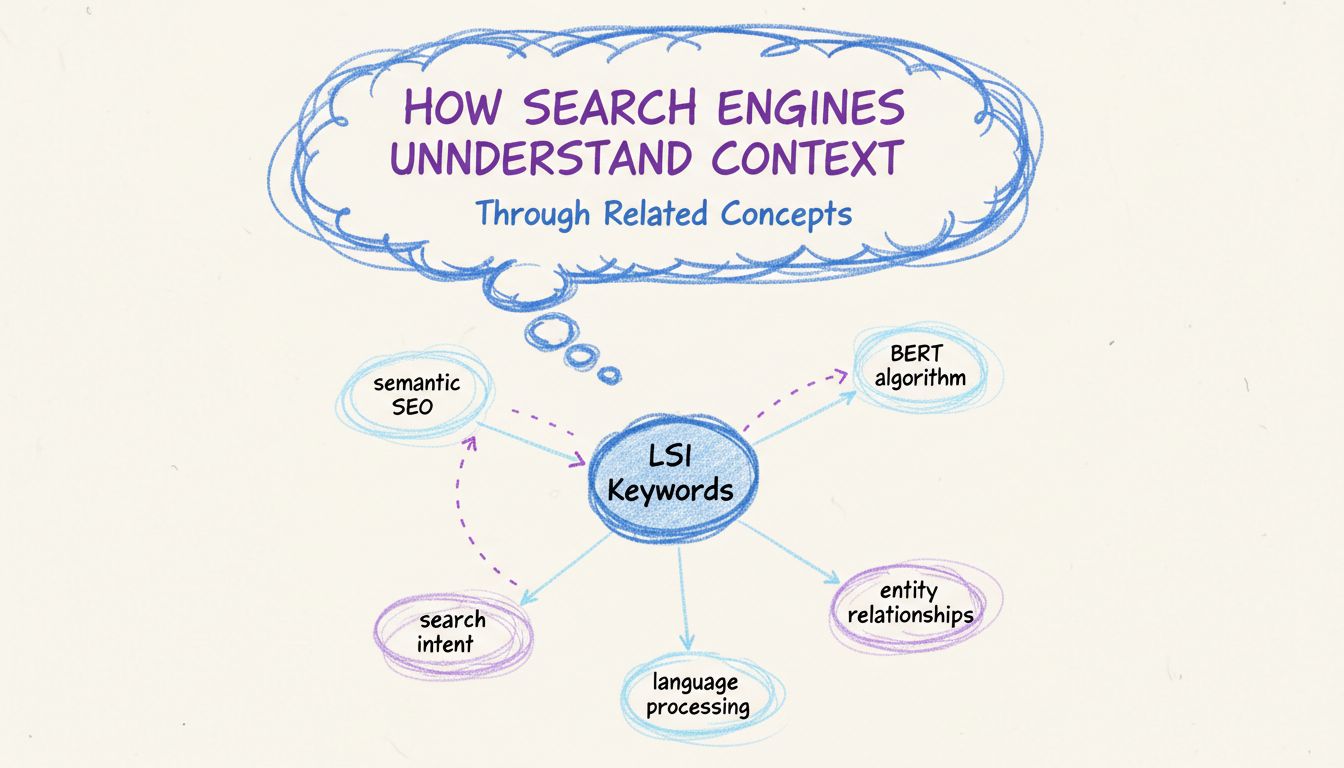

Dowiedz się, czy Google używa słów kluczowych LSI i jak naprawdę działa nowoczesne semantyczne wyszukiwanie. Poznaj BERT, RankBrain i optymalizację opartą na encjach, aby osiągać lepsze pozycje.

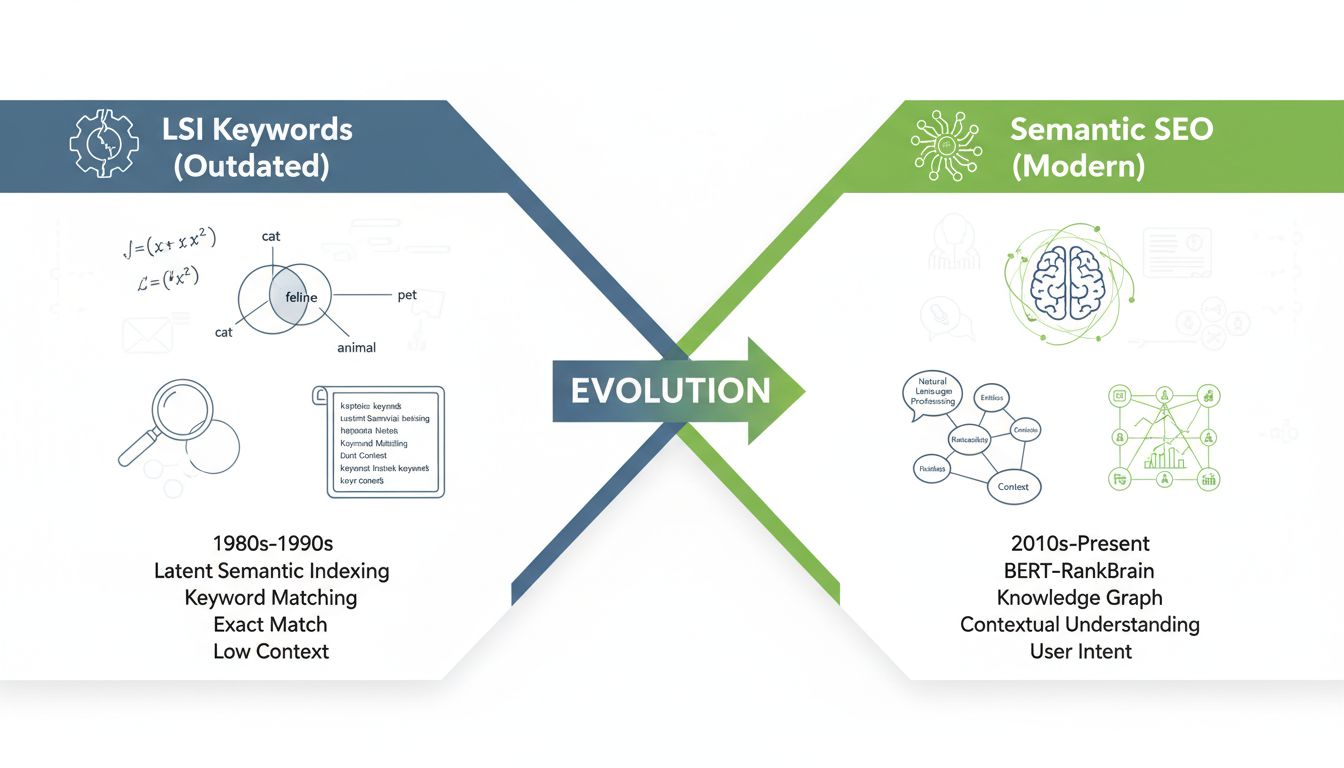

Nie, Google nie używa słów kluczowych LSI (Latent Semantic Indexing). John Mueller z Google wielokrotnie potwierdził, że LSI to przestarzała technologia z lat 80., której Google nigdy nie wdrożył. Zamiast tego Google korzysta z zaawansowanych technologii semantycznego wyszukiwania, takich jak BERT, RankBrain i Knowledge Graph, aby rozumieć znaczenie i kontekst treści.

Termin „słowa kluczowe LSI” funkcjonuje w branży SEO od ponad dekady, powodując powszechne zamieszanie wokół tego, jak Google naprawdę ocenia treść. Wielu marketerów wciąż wierzy, że umieszczanie list semantycznie powiązanych terminów wpływa na pozycjonowanie, podczas gdy w rzeczywistości Google odszedł od tego podejścia na długo przed tym, jak termin LSI stał się popularny w środowisku SEO. Zrozumienie różnicy między przestarzałą teorią LSI a nowoczesnym semantycznym wyszukiwaniem jest kluczowe dla każdego, kto zarządza programami partnerskimi lub tworzy treści mające dobrze pozycjonować się w 2025 roku.

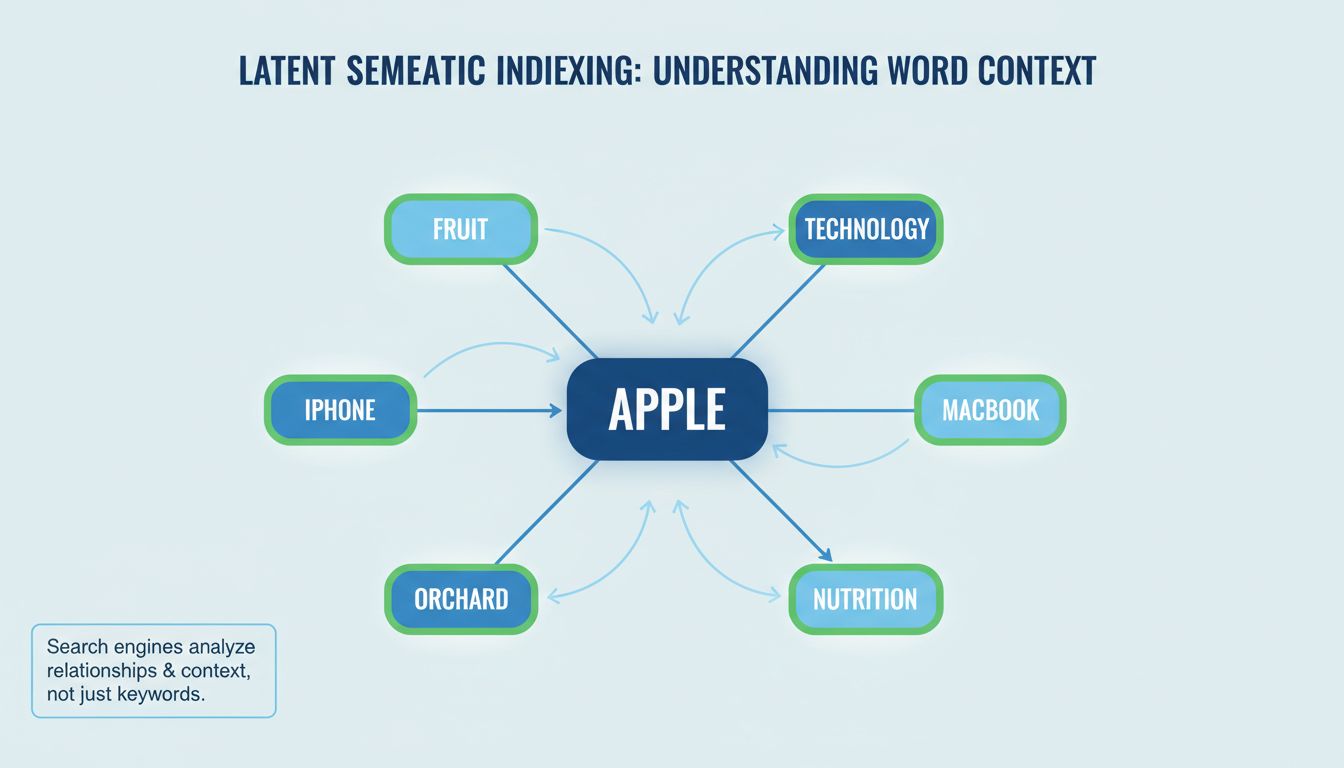

Latent Semantic Indexing był matematyczną techniką opracowaną pod koniec lat 80. do analizy relacji między słowami w zbiorach dokumentów. Metoda ta wykorzystywała dekompozycję wartości osobliwej do identyfikacji ukrytych wzorców współwystępowania terminów, co umożliwiało wczesnym systemom wyszukiwania rozpoznawanie, że „jabłko” może odnosić się zarówno do owocu, jak i do firmy technologicznej – w zależności od kontekstu. Choć w swoim czasie była to innowacja, LSI nigdy nie zostało zaprojektowane do skalowania na miliardy stron internetowych, a Google świadomie nie wdrożył tej technologii do swoich algorytmów rankingowych.

Google rozwinął się daleko poza proste dopasowywanie słów kluczowych czy analizę w stylu LSI. Gigant wyszukiwarkowy korzysta dziś z zaawansowanych systemów przetwarzania języka naturalnego, które rozumieją znaczenie na poziomie nieosiągalnym dla technologii z lat 80. Największy postęp nastąpił wraz z wprowadzeniem BERT (Bidirectional Encoder Representations from Transformers) w 2019 roku. BERT analizuje słowa w kontekście, patrząc na wyrazy przed i po nich, rozumiejąc niuanse, takie jak przyimki i określniki, które całkowicie zmieniają sens wypowiedzi.

RankBrain, system uczenia maszynowego Google wprowadzony w 2015 roku, zajmuje się interpretacją zapytań i dopasowywaniem ich do odpowiednich treści na podstawie znaczenia, a nie tylko ścisłego dopasowania słów kluczowych. System ten uczy się na miliardach wyszukiwań, rozumiejąc wzorce w tym, jak ludzie szukają i jakie treści rzeczywiście zaspokajają ich potrzeby. MUM (Multitask Unified Model), nowsze osiągnięcie Google, rozszerza te możliwości na złożone, wieloetapowe zapytania, a nawet analizę tekstu w połączeniu z obrazami.

Knowledge Graph to kolejny kluczowy element współczesnego rozumienia semantycznego. Ta ogromna baza danych mapuje encje – osoby, miejsca, produkty, pojęcia – i relacje między nimi. Gdy Google przetwarza zapytanie, nie szuka jedynie stron zawierających konkretne słowa, ale identyfikuje powiązane encje i znajduje treści, które omawiają te encje w odpowiednim kontekście. Takie podejście oparte na encjach jest fundamentalnie inne od LSI, które skupiało się na wzorcach współwystępowania słów, a nie na zrozumieniu, czym dane rzeczy naprawdę są.

Wielu ludzi używa pojęć „słowa kluczowe LSI” i „słowa kluczowe semantyczne” zamiennie, jednak to błędne utożsamianie zaciera istotną różnicę. Słowa kluczowe LSI odnoszą się do konkretnego algorytmu matematycznego, którego Google nigdy nie używał na szeroką skalę. Słowa kluczowe semantyczne oznaczają natomiast wyrazy i frazy powiązane kontekstowo z głównym tematem, które pomagają wyszukiwarkom zrozumieć pełen zakres Twojej treści. Zamieszanie powstało, ponieważ narzędzia SEO potrzebowały sposobu na określenie powiązanych terminów i „LSI keywords” stało się wygodnym skrótem – choć technicznie niepoprawnym.

Ta praktyczna różnica ma duże znaczenie dla strategii treści. Ślepe podążanie za listami słów kluczowych LSI często prowadzi do wymuszonego, nienaturalnego pisania, w którym twórcy próbują zamieścić każde sugerowane słowo niezależnie od tego, czy pasuje ono do treści. Takie podejście może wręcz zaszkodzić pozycjonowaniu, ponieważ współczesne wyszukiwarki karzą treści, które są sztucznie zoptymalizowane lub pozbawione spójności. Semantyczne SEO skupia się na głębokim zrozumieniu tematu i jasnym jego wyjaśnieniu, co naturalnie prowadzi do użycia słownictwa kontekstowego, które wyszukiwarki rozpoznają jako sygnały wiedzy i kompleksowości.

| Aspekt | Słowa kluczowe LSI | Semantyczne SEO |

|---|---|---|

| Używana technologia | Algorytm matematyczny z lat 80. | Nowoczesne NLP, BERT, RankBrain, Knowledge Graph |

| Wdrożenie w Google | Nigdy nieużywane na szeroką skalę | Kluczowy element systemu rankingowego |

| Metoda optymalizacji | Wstawianie listy słów kluczowych | Kompleksowe pokrycie tematu |

| Jakość pisania | Często wymuszone i nienaturalne | Naturalne, skoncentrowane na czytelniku |

| Wpływ na pozycjonowanie | Brak (bezpośredni) | Znaczący (pośredni przez klarowność) |

| Rozpoznawanie encji | Nie dotyczy | Kluczowe dla zrozumienia |

| Dopasowanie intencji użytkownika | Ograniczone | Zaawansowana interpretacja |

Gdy Google analizuje stronę internetową, nie liczy po prostu wystąpień słów kluczowych ani nie szuka z góry ustalonych list powiązanych terminów. Zamiast tego, analizuje całą stronę, aby zrozumieć, o czym ona rzeczywiście jest, jakie encje omawia i jak dobrze odpowiada na potrzeby użytkownika. Ta interpretacja odbywa się na wielu warstwach analizy, które razem tworzą kompleksowe zrozumienie znaczenia treści.

Przetwarzanie języka naturalnego umożliwia Google analizę struktury zdań, identyfikację relacji gramatycznych i zrozumienie, jak słowa się modyfikują. Dlatego strona o „przepisach na szarlotkę” jest rozumiana inaczej niż strona o „specyfikacji komputera Apple”, mimo że obie zawierają słowo „apple”. Otaczający kontekst – słowa takie jak „przepis”, „pieczenie”, „składniki” kontra „komputer”, „oprogramowanie”, „procesor” – dostarczają sygnałów semantycznych rozróżniających tematy.

Rozpoznawanie encji idzie jeszcze dalej, identyfikując konkretne rzeczy wspomniane w treści. Gdy Google napotyka „Steve Jobs”, nie widzi tylko imienia i nazwiska, lecz rozpoznaje odniesienie do konkretnej osoby o określonych atrybutach, relacjach i znaczeniu historycznym. Knowledge Graph łączy tę encję z powiązanymi pojęciami, takimi jak Apple Inc., innowacje, technologia i przedsiębiorczość. Ta sieć relacji pomaga Google zrozumieć nie tylko, o czym jest strona, ale również, jak wpisuje się ona w szerszy krajobraz wiedzy.

Przedstawiciele Google byli niezwykle klarowni w kwestii słów kluczowych LSI. W 2019 roku John Mueller, Search Advocate w Google, napisał wprost na Twitterze: „Nie istnieją słowa kluczowe LSI – każdy, kto mówi inaczej, jest w błędzie, przepraszam.” Nie była to przypadkowa uwaga, lecz świadome sprostowanie uporczywego nieporozumienia w branży SEO. Mueller powtarzał to stanowisko wielokrotnie, jasno dając do zrozumienia, że systemy rankingowe Google nie używają latent semantic indexing w żadnej formie.

Powód tej decyzji jest prosty: LSI zostało stworzone z myślą o niewielkich, statycznych zbiorach dokumentów w kontrolowanych warunkach. Nigdy nie zostało zaprojektowane do obsługi skali, różnorodności i dynamiczności współczesnego internetu. Założyciele Google szybko zdali sobie sprawę, że podejście LSI nie sprawdzi się przy pozycjonowaniu miliardów stron na niezliczone tematy i języki. Dlatego zainwestowali w systemy uczenia maszynowego, które mogłyby uczyć się na rzeczywistych zachowaniach użytkowników i stale adaptować do nowych wzorców.

Co więcej, matematyczne podejście LSI do odnajdywania relacji semantycznych jest bardzo prymitywne w porównaniu do możliwości sieci neuronowych. Sieć neuronowa wytrenowana na miliardach dokumentów potrafi nauczyć się znacznie bardziej subtelnych powiązań między pojęciami niż model matematyczny analizujący współwystępowanie terminów. Dlatego właśnie BERT i podobne systemy są o wiele skuteczniejsze w rozumieniu niuansów języka, kontekstu i znaczenia niż jakikolwiek algorytm z lat 80.

Choć same słowa kluczowe LSI nie wpływają na pozycje, to jednak podstawowa zasada – że wyszukiwarki analizują relacje semantyczne i kontekst – rzeczywiście ma ogromne znaczenie dla rankingów. Różnica polega na tym, że współczesne rozumienie semantyczne jest znacznie bardziej zaawansowane i działa na głębszym poziomie niż proste dopasowywanie słów kluczowych czy analiza współwystępowania terminów. Tworząc treści, które szeroko opisują temat i jasno wyjaśniają pojęcia, naturalnie generujesz sygnały semantyczne, które współczesne wyszukiwarki rozpoznają i nagradzają.

Kompleksowe pokrycie tematu to jeden z najważniejszych semantycznych sygnałów. Gdy strona omawia temat z wielu perspektyw, uwzględnia pojęcia pomocnicze i wyjaśnia relacje między koncepcjami, wyszukiwarki interpretują to jako oznakę eksperckości i użyteczności. Dlatego dłuższe treści często przewyższają krótsze – nie dlatego, że sama długość jest czynnikiem rankingowym, lecz ponieważ głębia pozwala na pełniejsze wyrażenie znaczenia semantycznego. Artykuł o długości 500 słów na temat „metod parzenia kawy” może wspomnieć o espresso, przelewie i French pressie, ale kompleksowy przewodnik na 3000 słów może szczegółowo opisać każdą metodę, przedstawić naukę ekstrakcji, wyjaśnić wybór sprzętu i omówić typowe błędy. Dłuższy tekst naturalnie zawiera więcej sygnałów semantycznych, bo szerzej omawia temat.

Jasność encji to kolejny kluczowy sygnał semantyczny. Gdy wyraźnie definiujesz, o jakich encjach piszesz i opisujesz ich relacje, pomagasz wyszukiwarkom zrozumieć sens Twoich treści. Jeśli piszesz o oprogramowaniu do marketingu afiliacyjnego, wyraźne rozróżnienie między różnymi platformami, wyjaśnienie, co je wyróżnia, i omówienie, jak odnoszą się do różnych modeli biznesowych, zapewnia klarowność semantyczną, która pomaga Google określić zakres i trafność Twojej treści.

Świadomość, że Google nie używa słów kluczowych LSI, lecz przykłada ogromną wagę do znaczenia semantycznego, powinna zasadniczo zmienić Twoje podejście do tworzenia treści. Zamiast szukać list słów kluczowych LSI i na siłę wplatać je w teksty, skup się na głębokim zrozumieniu tematu i jasnym jego wyjaśnieniu. Takie podejście przynosi korzyści zarówno czytelnikom, jak i wyszukiwarkom.

Zacznij od zbadania, jakie pytania Twoja grupa docelowa faktycznie zadaje na dany temat. Skorzystaj z sekcji „Podobne pytania” Google, podpowiedzi automatycznego uzupełniania oraz narzędzi typu AnswerThePublic, by zrozumieć pełen krajobraz intencji użytkowników. Te źródła ujawniają semantyczne powiązania, które mają znaczenie dla prawdziwych osób, a nie teoretyczne listy słów kluczowych. Jeśli ustrukturyzujesz treść tak, by kompleksowo odpowiadała na te pytania, naturalnie uwzględnisz słownictwo i pojęcia, które wyszukiwarki uznają za istotne.

Przeanalizuj strony o najwyższych pozycjach dla docelowych słów kluczowych, ale nie po to, by wydobyć z nich listy słów LSI. Zwróć uwagę, jak strukturyzują informacje, jakie podtematy poruszają, o jakich encjach wspominają i jak wyjaśniają relacje między pojęciami. Taka analiza ujawnia zakres semantyczny, którego oczekuje Google dla Twojego tematu. Jeśli każda z czołowych stron omawia „struktury prowizji partnerskich”, „przetwarzanie płatności” i „zapobieganie oszustwom” oprócz głównego zagadnienia, to nie są słowa kluczowe LSI, które musisz na siłę wstawiać – to niezbędne elementy kompleksowej treści, które powinieneś omówić w sposób naturalny.

Pomimo lat wyjaśnień ze strony Google, kilka mitów dotyczących LSI wciąż krąży w społecznościach SEO i materiałach szkoleniowych. Jednym z nich jest przekonanie, że narzędzia do słów kluczowych LSI zapewniają szczególny wgląd w mechanizmy rankingu Google. W rzeczywistości narzędzia te po prostu pokazują powiązane terminy i synonimy – informacje, które możesz uzyskać za darmo, korzystając z funkcji wyszukiwania Google. „LSI” w nazwie tych narzędzi to czysty marketing; nie stosują one żadnej analizy latent semantic indexing.

Kolejny popularny mit głosi, że należy użyć określonej liczby lub procentu słów kluczowych LSI dla optymalnego pozycjonowania. Takie podejście prowadzi do szablonowego, nienaturalnego pisania, które w rzeczywistości szkodzi jakości treści. Współczesne wyszukiwarki oceniają treść całościowo, a nie przez odhaczanie wymagań dotyczących słów kluczowych. Strona, która naturalnie wplata istotne pojęcia, zachowując świetną czytelność i doświadczenie użytkownika, przewyższy tę, która sztucznie wstawia więcej słów kluczowych, lecz brzmi niezręcznie.

Niektórzy marketerzy wciąż wierzą, że słowa kluczowe LSI mogą zrekompensować ubogą lub niskiej jakości treść. To całkowicie błędne myślenie. Dodanie powiązanych terminów do powierzchownej treści nie czyni jej kompleksową ani autorytatywną. Wyszukiwarki oceniają rzeczywistą głębię wyjaśnień, jakość informacji i to, czy treść faktycznie odpowiada na potrzeby użytkownika. Żadne urozmaicenie słownictwa nie zastąpi prawdziwej wiedzy i szerokiego omówienia tematu.

Zamiast podążać za przestarzałymi mitami SEO, skuteczni menedżerowie programów partnerskich potrzebują narzędzi, które pokazują, co rzeczywiście generuje konwersje i zaangażowanie. PostAffiliatePro dostarcza kompleksową analitykę i śledzenie, które dokładnie pokazują, które strategie treści, partnerzy i podejścia marketingowe przynoszą realne rezultaty. Zamiast zgadywać, czy Twoja optymalizacja semantyczna działa, możesz zobaczyć konkretne dane o źródłach ruchu, współczynnikach konwersji i przypisaniu przychodów.

Zaawansowane raporty w PostAffiliatePro pomagają zrozumieć związek między strategią treści a rzeczywistymi wynikami biznesowymi. Możesz śledzić, które strony generują najwartościowszy ruch, którzy partnerzy przynoszą najcenniejsze konwersje oraz jak różne podejścia do treści wpływają na Twój wynik finansowy. Takie podejście oparte na danych jest znacznie skuteczniejsze niż podążanie za ogólnikowymi poradami SEO, ponieważ opiera się na Twojej konkretnej grupie odbiorców, rynku i modelu biznesowym.

Platforma umożliwia również śledzenie w czasie rzeczywistym i szczegółową analizę zachowań użytkowników, dzięki czemu możesz zidentyfikować możliwości optymalizacji, których nie wychwycą ogólne narzędzia SEO. Zobaczysz dokładnie, jak użytkownicy wchodzą w interakcję z Twoimi treściami, gdzie rezygnują i jakie komunikaty rezonują najmocniej. Ta wiedza pozwoli Ci udoskonalić strategię treści w oparciu o rzeczywiste zachowania użytkowników, a nie teoretyczne najlepsze praktyki.

Utrzymujące się dyskusje o słowach kluczowych LSI w 2025 roku pokazują rozdźwięk między przestarzałą teorią SEO a współczesną rzeczywistością wyszukiwania. Google od dawna podkreśla: słowa kluczowe LSI nie są częścią ich systemów rankingowych. Liczy się rozumienie semantyczne – zdolność wyszukiwarek do zrozumienia, o czym naprawdę są Twoje treści, jakie encje omawiają i jak dobrze odpowiadają na potrzeby użytkowników.

Dla marketerów afiliacyjnych i twórców treści to dobra wiadomość. Zamiast poświęcać czas na szukanie list słów kluczowych LSI i wciskanie ich do tekstów, zainwestuj wysiłek w dogłębne poznanie tematu i jasne wyjaśnienie go odbiorcom. Najpierw pisz dla ludzi, potem optymalizuj pod wyszukiwarki i zaufaj, że kompleksowe, dobrze zorganizowane treści naturalnie zawierają sygnały semantyczne, które współczesne wyszukiwarki rozpoznają i nagradzają.

Przyszłość SEO to nie sztuczki ze słowami kluczowymi czy mechaniczna optymalizacja – to tworzenie naprawdę wartościowych treści, które pokazują wiedzę i odpowiadają na prawdziwe potrzeby odbiorców. Skupiając się na klarowności semantycznej, kompleksowym pokryciu tematu i zrozumieniu encji, tworzysz treści, które osiągają wysokie pozycje nie tylko w tradycyjnych wynikach Google, ale także w odpowiedziach generowanych przez AI i na nowych platformach wyszukiwania. To prawdziwa przewaga konkurencyjna w 2025 roku i później.

Przestań zgadywać w kwestii SEO i zacznij śledzić to, co naprawdę działa. Zaawansowana analityka PostAffiliatePro pomoże Ci zrozumieć, które strategie treści generują realne konwersje partnerskie. Zdobądź wgląd, którego potrzebujesz, aby zbudować dochodowy program partnerski.

Poznaj prawdę o słowach kluczowych LSI w 2025 roku. Dowiedz się, dlaczego Google nie używa LSI, co rzeczywiście wpływa na ranking SEO i jak optymalizować treści...

Dowiedz się, jak latentne indeksowanie semantyczne wpływa na SEO w 2025 roku. Odkryj, jak słowa kluczowe LSI poprawiają pozycje w wyszukiwarkach, trafność treśc...

LSI, czyli latent semantic indexing, to matematyczna metoda wykorzystywana przez wyszukiwarki w celu ograniczenia stron spamowych i poprawy trafności treści w S...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.